¶ Importance

Les fonctionnalités d’évolutivité et les configurations de stockage défini par logiciel dans vSphere peuvent vous aider à gérer efficacement la croissance dans votre environnement.

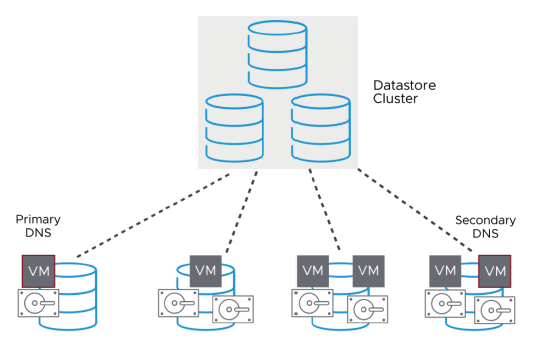

Pour la croissance des datastores et les problèmes d’équilibrage, vous pouvez utiliser vSphere Storage DRS.

Avec les connaissances et les compétences en gestion basée sur les stratégies de stockage, vous pouvez aligner le stockage sur les exigences applicatives de vos VMs.

¶ Leçons du module

- Systèmes de stockage NVMe

- Extension iSCSI pour RDMA (iSER)

- Datastores VMFS

- Datastores vSAN

- vSphere Storage APIs – Array Integration (VAAI)

- vSphere Storage API for Storage Awareness et vSphere APIs for I/O Filtering (VASA et VAIO)

- Vue d’ensemble de la gestion basée sur les stratégies de stockage

- Utilisation des stratégies de stockage de VM

- Stratégies de stockage pour vSAN

- Stratégies de stockage pour vSphere Virtual Volumes

- Storage I/O Control

- Datastore Clusters et vSphere Storage DRS

¶ Leçon 1 : Systèmes de stockage NVMe

¶ Objectifs d’apprentissage

- Identifier la prise en charge du NVMe

- Configurer ESXi pour NVMe over RDMA (RoCE v2)

- Décrire l’architecture VMware Pluggable Storage Architecture (PSA)

- Décrire le but du High-Performance Plug-in (HPP)

¶ Prise en charge de vSphere pour NVMe

Non-Volatile Memory Express (NVMe) est un protocole standardisé pour la communication multi-queue haute performance avec des périphériques NVM.

ESXi prend en charge le protocole NVMe pour se connecter à des périphériques de stockage locaux et en réseau.

Introduit dans vSphere 7, les fonctionnalités suivantes ont été ajoutées pour améliorer la prise en charge du NVMe :

- Pluggable Storage Architecture (PSA) utilisant un High-Performance Plug-In (HPP) avec multipathing

- Ajout et retrait à chaud de périphériques NVM locaux, si le serveur le prend en charge

- Prise en charge des périphériques NVMe en réseau connectés via Fibre Channel ou RDMA

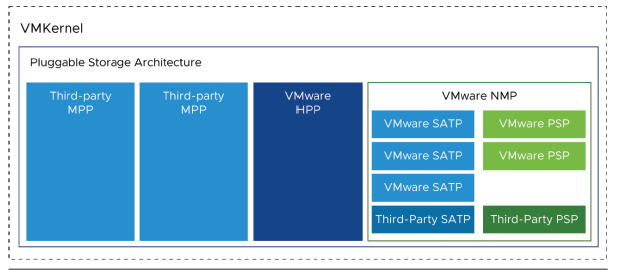

ESXi utilise la Pluggable Storage Architecture (PSA) comme couche VMkernel pour la gestion du multipathing du stockage.

La PSA est une structure ouverte et modulaire. Elle coordonne les modules logiciels responsables des opérations de multipathing.

Les modules incluent des multipathing modules (MPPs) génériques fournis par VMware, tels que le Native Multipathing Plug-In (NMP) et le High Performance Plug-In (HPP), ainsi que des MPPs tiers.

¶ Topologies NVMe prises en charge

Le stockage NVMe peut être directement connecté à un hôte ou indirectement via différents fabric transports, ce qui est connu sous le nom de Shared NVMe over Fabrics, ou simplement NVMe-oF.

| NVMe Transport | Prise en charge à partir de ESXi 7 et versions ultérieures |

|---|---|

| NVMe over PCIe | Stockage local |

| NVMe over RDMA | Stockage partagé NVMe-oF |

| NVMe over Fibre Channel (FC-NVMe) | Stockage partagé NVMe-oF |

| NVMe over TCP | Stockage partagé NVMe-oF |

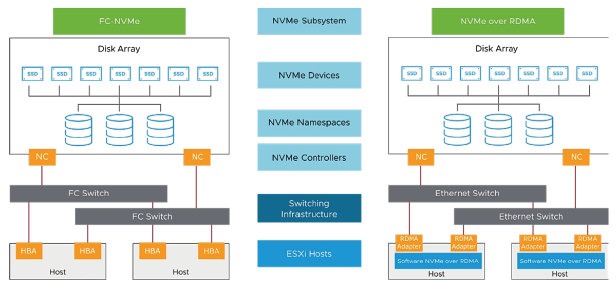

¶ FC-NVMe et NVMe over RDMA (RoCE v2)

vSphere 7 et les versions ultérieures prennent en charge l’accès à distance au NVMe-oF.

Cela inclut à la fois les topologies "FC-NVMe et NVMe over RDMA".

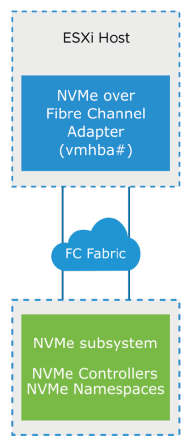

¶ Prise en charge du FC-NVMe

FC-NVMe est une technologie qui permet de mapper le protocole NVMe sur le protocole Fibre Channel.

Avec FC-NVMe, les données et les commandes peuvent être transférées entre un ordinateur hôte et un périphérique de stockage cible.

Pour accéder au stockage FC-NVMe, vous devez installer un adaptateur de stockage Fibre Channel compatible NVMe sur votre hôte ESXi.

Vous n’avez pas besoin de configurer le contrôleur. Une fois l’adaptateur matériel NVMe requis installé, il se connecte automatiquement à toutes les cibles (targets) et contrôleurs accessibles.

Votre hôte ESXi détecte le périphérique et l’affiche dans le vSphere Client comme un adaptateur Fibre Channel (vmhba) standard, avec le protocole de stockage indiqué comme NVMe.

Vous n’avez pas besoin de configurer le contrôleur.

Une fois que vous avez installé l’adaptateur matériel NVMe requis, il se connecte automatiquement à toutes les cibles et contrôleurs qu’il peut atteindre.

Vous pouvez ensuite reconfigurer l’adaptateur et déconnecter ses contrôleurs, ou connecter d’autres contrôleurs qui n’étaient pas disponibles lors du démarrage de l’hôte.

¶ Exigences pour FC-NVMe

Lorsque vous utilisez FC-NVMe, les composants suivants sont requis :

- Une baie de stockage Fibre Channel prenant en charge NVMe.

- Un contrôleur NVMe sur votre baie de stockage.

- ESXi 7 ou version ultérieure.

- Un adaptateur matériel NVMe sur votre hôte ESXi : cet adaptateur est généralement un adaptateur Fibre Channel Host Bus Adapter (HBA) prenant en charge NVMe.

Valeurs maximales de configuration pour NVMe-oF :

- 256 namespaces

- 2048 paths

- 4 paths par namespace et par hôte

Pour plus d’informations sur les concepts NVMe, consultez le chapitre intitulé About VMware NVMe Storage dans la documentation vSphere Storage, disponible à l’adresse suivante : https://docs.vmware.com/en/VMware-vSphere/8.0/vsphere-esxi-vcenter-80-storage-guide.pdf

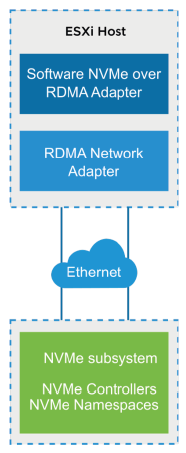

¶ Prise en charge de NVMe over RDMA (RoCE v2)

La technologie NVMe over RDMA (RoCE v2) utilise RDMA pour le transport entre deux systèmes sur le réseau.

L’échange de données s’effectue directement en mémoire principale, contournant le système d’exploitation et le processeur des deux systèmes.

ESXi 7 et les versions ultérieures prennent en charge la technologie RoCE v2, qui permet le RDMA sur un réseau Ethernet.

Pour accéder au stockage, l’hôte ESXi utilise un adaptateur réseau RDMA installé sur l’hôte ainsi qu’un adaptateur de stockage NVMe over RDMA logiciel.

Le NVMe over RDMA avec la technologie RoCE v2 offre un stockage ultra-efficace permettant d’optimiser les charges de travail sensibles aux performances sur votre infrastructure Ethernet existante.

Vous devez configurer les deux adaptateurs pour pouvoir effectuer la détection du stockage.

Le processus de configuration des adaptateurs consiste à configurer la liaison VMkernel pour un adaptateur réseau RDMA et activer un adaptateur NVMe over RDMA logiciel.

¶ Exigences pour NVMe over RDMA (RoCE v2)

Le NVMe over RDMA (RoCE v2) nécessite les composants suivants :

- Une baie de stockage NVMe prenant en charge le transport NVMe over RDMA (RoCE v2)

- Un contrôleur NVMe sur votre baie de stockage

- ESXi 7 ou version ultérieure

- Des Switches Ethernet prenant en charge un réseau sans perte (lossless network)

- Un adaptateur réseau sur votre hôte ESXi prenant en charge RoCE v2

- Un adaptateur NVMe over RDMA logiciel activé sur vos hôtes ESXi

Valeurs maximales de configuration pour NVMe-oF :

- 32 namespaces

- 128 chemins (paths)

- 4 chemins par namespace et par hôte

¶ Configuration d’ESXi pour NVMe over RDMA (RoCE v2)

Pour configurer votre hôte ESXi afin d’utiliser NVMe over RDMA (RoCE v2) :

- Sur votre hôte ESXi, installez une interface réseau prenant en charge RDMA (RoCE v2).

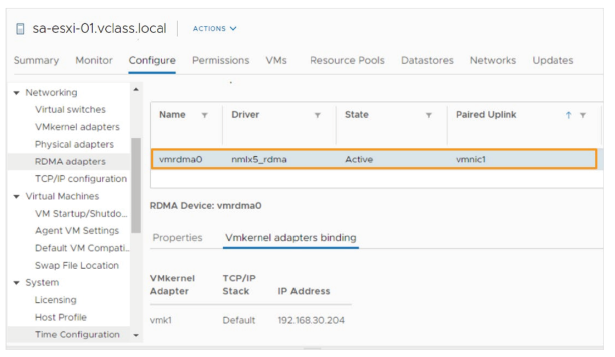

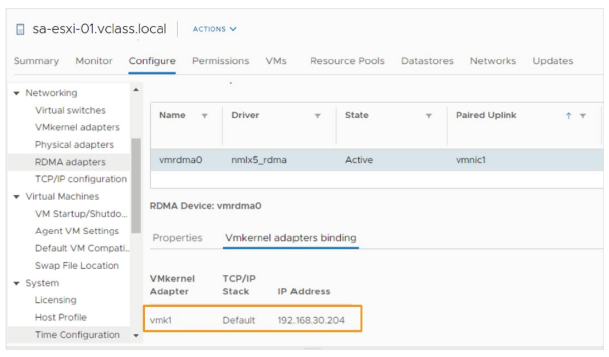

- Dans le vSphere Client, vérifiez que l’adaptateur RDMA est détecté par votre hôte.

- Configurez la liaison VMkernel pour l’adaptateur RDMA.

- Vérifiez la configuration de la liaison VMkernel pour l’adaptateur RDMA.

- Activez l’adaptateur NVMe over RDMA logiciel.

- Découvrez les contrôleurs NVMe sur votre baie (automatiquement ou manuellement).

- Analysez à nouveau le stockage (rescan storage) pour découvrir les namespaces NVMe.

- Créez vos datastores.

Identifiez l’adaptateur réseau physique qui correspond à l’adaptateur RDMA.

La configuration du Port binding pour NVMe over RDMA consiste à créer un Switch et à connecter l’adaptateur réseau physique et l’adaptateur VMkernel à ce Switch.

Grâce à cette connexion, l’adaptateur RDMA devient lié à l’adaptateur VMkernel.

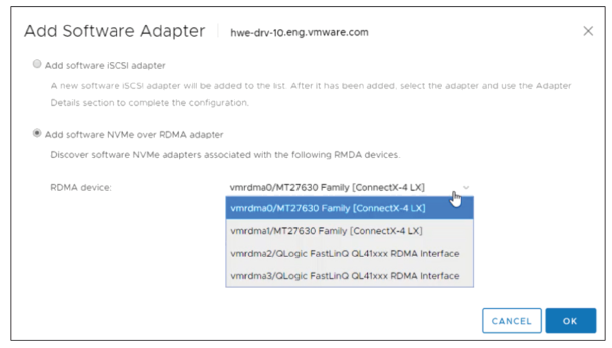

Sélectionnez Add software NVMe over RDMA adapter et choisissez un adaptateur RDMA approprié (vmrdma) dans le menu déroulant.

L’adaptateur software NVMe over RDMA apparaît alors dans la liste en tant qu’adaptateur de stockage vmhba.

Vous pouvez supprimer cet adaptateur si vous devez libérer l’adaptateur réseau RDMA sous-jacent pour d’autres usages.

Pour plus d’informations sur la configuration des adaptateurs pour NVMe over RDMA (RoCE v2), consultez la documentation VMware : Configuring Adapters for NVMe over RDMA (RoCE v2) Storage

¶ Architecture de stockage enfichable (Pluggable Storage Architecture)

La Pluggable Storage Architecture (PSA) est un cadre ouvert et modulaire qui coordonne divers modules logiciels responsables des opérations de multipathing.

| Acronyme | Définition |

|---|---|

| PSA | Pluggable Storage Architecture |

| NMP | Native Multipathing Plug-in : Module de multipathing VMware générique utilisé avec les périphériques de stockage SCSI |

| PSP | Path Selection Plug-in : Gère la sélection de chemin pour un périphérique de stockage SCSI |

| SATP | Storage Array Type Plug-in : Gère le basculement de chemin pour une baie de stockage SCSI donnée |

| Acronyme | Définition |

|---|---|

| MPP (third party) | Multipathing Plug-in : Module de multipathing développé et fourni par un tiers |

| HPP | High-Performance Plug-in fourni par VMware : Utilisé avec les périphériques flash locaux et en réseau à très haute vitesse |

| PSS | Path Selection Scheme : Gère le multipathing pour les périphériques de stockage NVMe |

VMware fournit des modules de multipathing natifs génériques, appelés VMware NMP et VMware HPP.

De plus, la PSA offre un ensemble d’API VMkernel que les développeurs tiers peuvent utiliser.

Les développeurs de logiciels peuvent créer leurs propres modules d’équilibrage de charge et de basculement pour une baie de stockage spécifique. Ces modules de multipathing tiers (MPP) peuvent être installés sur l’hôte ESXi et fonctionner en plus des modules VMware natifs, ou les remplacer.

Comme le montre le schéma de la diapositive précédente, plusieurs MPP tiers peuvent s’exécuter en parallèle avec les modules VMware NMP ou HPP.

Une fois installés, les MPP tiers peuvent remplacer le comportement des modules natifs. Les MPP peuvent prendre le contrôle du basculement de chemin et des opérations d’équilibrage de charge pour les périphériques de stockage spécifiés.

¶ Plug-in haute performance (HPP) pour NVMe

Le HPP (High-Performance Plug-in) assure les fonctions suivantes :

- Sert de plug-in par défaut qui revendique les cibles NVMe-oF.

- Prend en charge uniquement les cibles ALUA (Asymmetric Logical Unit Access) actives-actives et implicites.

- Améliore les performances des périphériques flash ultra-rapides installés sur ESXi.

- Peut remplacer le Native Multipathing Plug-in (NMP) pour les périphériques NVMe locaux.

- Prend en charge le multipathing pour NVMe-oF.

Pour prendre en charge le multipathing, le HPP utilise un schéma de sélection de chemin (PSS – Path Selection Scheme) lors de la sélection des chemins physiques pour les requêtes d’E/S.

Vous pouvez utiliser vSphere ESXi Shell ou la vSphere CLI (avant vSphere 7.0) pour configurer le HPP et le PSS.

À partir de vSphere 7 et versions ultérieures, le HPP intègre la logique de sélection et de basculement de chemin dans un seul module, ce qui réduit les appels inter-modules.

Pour les périphériques NVMe locaux, NMP reste le plug-in par défaut, mais il est possible de le remplacer par le HPP.

¶ Prise en charge du multipathing avec le Plug-in haute performance (HPP)

Le HPP (High-Performance Plug-in) améliore les performances des périphériques NVMe sur votre hôte ESXi.

| Prise en charge HPP | vSphere 7 et versions ultérieures |

|---|---|

| Périphériques de stockage | NVMe PCIe local NVMe-oF partagé (uniquement pour les cibles actives-actives et les cibles ALUA implicites) |

| Multipathing | Oui |

| Plug-ins de second niveau | Non Schéma de sélection de chemin (PSS – Path Selection Scheme) |

| Réservations persistantes SCSI-3 | Non |

| Périphériques 4Kn avec émulation logicielle | Non |

| vSAN | Oui |

¶ Bonnes pratiques pour le Plug-in haute performance (HPP)

Pour obtenir le débit le plus rapide à partir d’un périphérique de stockage haute vitesse, suivez les recommandations suivantes :

- Utilisez le HPP pour les périphériques NVMe locaux ou en réseau.

- N’activez pas le HPP pour les disques durs (HDD) ou les périphériques flash plus lents.

- Lors de l’utilisation de FC-NVMe, suivez les recommandations générales pour le stockage Fibre Channel.

- Lors de l’utilisation de NVMe-oF, ne mélangez pas les types de transport pour accéder au même namespace.

- Avant d’enregistrer les namespaces NVMe-oF, assurez-vous que les chemins actifs sont présentés à l’hôte.

- Configurez vos machines virtuelles (VM) pour utiliser les contrôleurs paravirtuels VMware (PVSCSI).

- Configurez vos VMs pour utiliser la sensibilité haute latence.

- Si une seule VM gère une part importante de la charge d’E/S du périphérique, envisagez de répartir les opérations d’E/S sur plusieurs disques virtuels, en attachant ces disques à des contrôleurs virtuels distincts dans la VM.

N’activez pas le HPP pour les disques durs ou les périphériques flash plus lents. Le HPP n’apporte aucun avantage de performance pour des périphériques incapables d’atteindre au moins 200 000 IOPS.

Si vous n’attachez pas les disques à des contrôleurs virtuels séparés dans la VM, le débit d’E/S peut être limité. Cette limitation est due à la saturation du cœur CPU chargé de traiter les opérations d’E/S sur un contrôleur de stockage virtuel.

¶ Revue des objectifs d’apprentissage

- Identifier la prise en charge du NVMe

- Configurer ESXi pour NVMe over RDMA (RoCE v2)

- Décrire l’architecture de stockage enfichable (Pluggable Storage Architecture) de VMware

- Décrire le rôle du Plug-in haute performance (HPP)

¶ Leçon 2 : Extension iSCSI pour RDMA (iSER)

¶ Objectifs d'apprentissage

- Décrire la prise en charge d’iSER dans vSphere

- Configurer iSER sur les hôtes ESXi

¶ À propos d’iSER

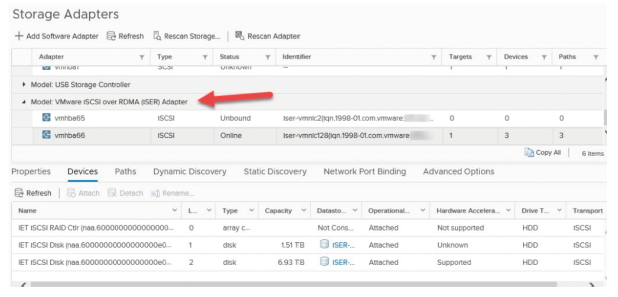

Les extensions iSCSI pour RDMA (iSER) offrent une connectivité iSCSI hautes performances pour les cartes réseau RDMA standard.

En plus de la prise en charge de l’iSCSI traditionnel, ESXi prend également en charge le protocole iSER.

Lorsque le protocole iSER est activé, le framework iSCSI sur l’hôte ESXi peut utiliser le transport RDMA au lieu de TCP/IP.

vSphere 7.0 a ajouté la prise en charge des volumes virtuels vSphere (vVols) via iSER.

À partir de vSphere 7 et versions ultérieures, la prise en charge d’iSER nécessite les éléments suivants :

- Des périphériques compatibles RoCE

- Une baie de stockage cible prenant en charge iSER sur RoCE

¶ Configuration d’iSER**

Configurez iSER sur votre hôte ESXi afin que le framework iSCSI sur l’hôte puisse utiliser le transport Remote Direct Memory Access (RDMA) à la place de TCP/IP.

| Étape de configuration | Description |

|---|---|

| Activer l’adaptateur VMware iSER. | Utilisez la commande esxcli pour activer l’adaptateur VMware iSER. |

| Modifier les propriétés générales des adaptateurs iSCSI ou iSER. | Si nécessaire, modifiez le nom par défaut et l’alias attribué à votre adaptateur. |

| Configurer la liaison de port pour iSCSI ou iSER. | Vous devez créer des connexions réseau pour lier le moteur iSER et l’adaptateur réseau compatible RDMA. |

| Configurer la découverte dynamique ou statique pour iSCSI et iSER. | En mode de découverte dynamique, chaque fois que l’initiateur contacte un système de stockage iSER spécifié, il envoie une requête SendTargets au système. En mode statique, vous devez entrer manuellement les informations des cibles. |

| Configurer CHAP pour iSCSI ou iSER. | Cette étape est nécessaire uniquement si votre environnement utilise le protocole CHAP (Challenge Handshake Authentication Protocol). |

| Activer les trames jumbo pour la mise en réseau. | Si votre environnement prend en charge les trames jumbo, activez-les pour l’adaptateur. |

Lorsqu’il est installé sur l’hôte, l’adaptateur compatible RDMA apparaît dans vCenter Server comme un adaptateur réseau (vmnic).

Pour rendre l’adaptateur fonctionnel, vous devez activer le composant VMware iSER et connecter l’adaptateur iSER au vmnic compatible RDMA. Vous pouvez ensuite configurer des propriétés telles que les cibles et CHAP pour l’adaptateur iSER.

Remarque : iSER ne prend pas en charge le NIC teaming. Lors de la configuration de la liaison de port, utilisez un seul adaptateur RDMA par commutateur virtuel.

¶ Exigences pour iSER

Pour activer l’adaptateur VMware iSER, utilisez la commande esxcli et assurez-vous de répondre aux exigences suivantes :

- Vérifiez que votre stockage iSCSI prend en charge le protocole iSER.

- Installez l’adaptateur compatible RDMA sur votre hôte ESXi.

- Utilisez le commutateur compatible RDMA.

- Activez le contrôle de flux sur l’hôte ESXi. Pour activer le contrôle de flux sur l’hôte, utilisez la commande :

esxcli system module parameters - Configurez les ports du commutateur RDMA pour créer des connexions sans perte entre l’initiateur iSER et la cible.

Pour plus d’informations sur l’activation du contrôle de flux, consultez l’article 1013413 de la base de connaissances VMware à l’adresse : http://kb.vmware.com/kb/1013413

¶ Exécution d’iSER

Exécutez la commande suivante depuis l’hôte ESXi pour activer l’adaptateur iSER : esxcli rdma iser add

¶ Revue des objectifs d’apprentissage

- Décrire la prise en charge d’iSER dans vSphere

- Configurer iSER sur les hôtes ESXi

¶ Leçon 3 : Datastores VMFS

¶ Objectifs d'apprentissage

- Expliquer pourquoi VMFS est un système de fichiers haute performance et évolutif

- Identifier les améliorations de performance de VMFS6 par rapport à VMFS5

- Décrire la procédure de migration de VMFS5 vers VMFS6

¶ À propos des Datastores VMFS

Les datastores VMFS sont des conteneurs logiques qui masquent les spécificités du stockage physique des machines virtuelles et fournissent un modèle uniforme pour le stockage des fichiers de machines virtuelles.

VMFS est un système de fichiers en cluster haute performance, optimisé pour les machines virtuelles.

vSphere 6.5 et les versions ultérieures prennent en charge les datastores VMFS5 et VMFS6.

VMFS5 a été introduit dans vSphere 5.0. VMFS6 a été introduit dans vSphere 6.5.

¶ Datastores VMFS5 et VMFS6

Les datastores VMFS5 et VMFS6 sont hautement évolutifs :

- La taille maximale d’un datastore ou d’une seule étendue est de 64 To.

- La taille du bloc du système de fichiers est de 1 Mo, ce qui prend en charge des fichiers allant jusqu’à 62 To.

- Les petits fichiers sont stockés efficacement :

— Les blocs du système de fichiers sont divisés en sous-blocs pour un stockage optimal des petits fichiers.

— Les données des petits fichiers (inférieurs ou égaux à 1 Ko) sont stockées directement dans le descripteur de fichier. - Un disque virtuel peut être étendu à chaud à n’importe quelle taille, jusqu’à 62 To.

Pour plus d’informations sur la fonctionnalité d’extension à chaud, consultez vSphere Storage à l’adresse suivante : https://docs.vmware.com/en/VMware-vSphere/8.0/vsphere-esxi-vcenter-80-storage-guide.pdf

¶ Datastores VMFS6

VMFS6 apporte des améliorations en termes d’évolutivité et de performance par rapport à VMFS5 :

- Les datastores VMFS6 (et NFS) peuvent être montés sur jusqu’à 128 hôtes ESXi.

- Temps de création de fichiers plus rapides.

- Opérations disque parallèles et transactions simultanées.

Un VMDK partagé sur VMFS6 prend en charge les réservations persistantes SCSI-3 (SCSI-3 PR) au niveau du disque virtuel (VMDK) :

- Un cluster de basculement Windows Server (WSFC) peut utiliser des disques partagés sur VMFS.

- Il peut prendre en charge des disques virtuels en cluster sur certains datastores (si le matériel le permet).

- Vous pouvez utiliser le vSphere Client pour migrer des RDMs vers VMFS.

Pour les RDMs en compatibilité virtuelle, vous pouvez effectuer une migration Storage vMotion.

Pour les RDMs en compatibilité physique vers des disques virtuels, un temps d’arrêt est nécessaire pour effectuer la migration.

¶ Formats des périphériques de stockage

ESXi prend en charge les périphériques de stockage utilisant des formats de secteur traditionnels et avancés :

- 512n : format de secteur traditionnel.

- 512e (émulation de 512 octets) : un disque 4K capable d’émuler des secteurs de 512 octets pour les applications et systèmes d’exploitation anciens.

- 4Kn (4K natif) : présente des secteurs de 4 Ko sans aucune émulation.

| Format de secteur | Taille de secteur logique | Taille de secteur physique |

|---|---|---|

| 512n | 512 | 512 |

| 512e | 512 | 4 096 |

| 4Kn | 4 096 | 4 096 |

L’industrie du stockage évolue vers des disques à format avancé afin de fournir des disques de grande capacité pour les serveurs et baies de stockage.

Les disques 4K offrent plusieurs avantages par rapport aux disques à secteurs de 512 octets :

- Réduction du coût total de possession (TCO) : les disques 4K nécessitent moins d’espace pour les codes de correction d’erreurs (ECC) que les disques 512 octets classiques. Cet espace libéré permet une densité de données plus élevée sur les disques 4K, ce qui améliore le coût total de possession.

- Meilleure disponibilité : les disques 4K disposent d’un champ ECC plus grand, améliorant ainsi la correction d’erreurs et l’intégrité des données.

- Meilleures performances : les disques 4K devraient offrir de meilleures performances que les disques 512 octets. Toutefois, cette amélioration n’est réelle que si le système d’exploitation invité est configuré pour exécuter des opérations d’E/S alignées sur la taille de secteur 4K.

Comme les applications et systèmes d’exploitation anciens ne prennent pas en charge les disques 4K natifs, l’industrie a introduit les disques 4K avec taille de secteur émulée en 512 octets pour garantir la compatibilité.

Ces disques ont une taille de secteur physique de 4 Ko, mais une taille logique de 512 octets.

Ces disques sont appelés disques 512e, où la lettre e signifie émulation.

Les disques 512e facilitent l’adoption des disques 4K.

L’objectif final de l’industrie est de migrer entièrement vers des disques 4K natifs (4Kn).

¶ Périphériques de stockage pris en charge par les datastores VMFS

Vous pouvez déployer des datastores VMFS5 et VMFS6 sur des périphériques de stockage 512n et 512e.

Avec vSphere 6.7 et les versions ultérieures, les datastores VMFS6 peuvent également être déployés sur des périphériques de stockage 4Kn connectés directement.

ESXi continue d’exposer des fichiers de disque virtuel avec des secteurs de 512 octets au système d’exploitation invité.

| Périphérique de stockage | Pris en charge par VMFS5 | Pris en charge par VMFS6 |

|---|---|---|

| 512n | Oui | Oui |

| 512e | Oui. Cependant, VMFS5 n’est pas pris en charge sur les périphériques 512e locaux. | Oui |

| 4Kn | Non | Oui |

Pour plus d’informations sur la compatibilité de vSphere avec les disques 512e et 4K natifs, consultez l’article de la base de connaissances VMware 2091600 à l’adresse : http://kb.vmware.com/kb/2091600

¶ Limitations liées à l’utilisation de disques 4Kn

Lorsqu’ils sont utilisés dans un environnement vSphere, les disques 4Kn présentent les limitations suivantes :

-

Seuls les disques durs locaux SAS et SATA sont pris en charge.

-

Les disques SSD 4Kn, NVMe 4Kn et les disques 4Kn utilisés en RDM ne sont pas pris en charge.

-

Le démarrage à partir de disques 4Kn n’est pris en charge qu’en mode UEFI.

-

Seul le Native Multipathing Plug-In (NMP) peut gérer les périphériques 4Kn :

- Le High-Performance Plug-In (HPP) ne peut pas être utilisé pour ces périphériques.

- Les plug-ins multipathing tiers ne sont pas pris en charge.

-

Pour vSAN, les disques 4Kn peuvent uniquement être utilisés comme disques durs de capacité (HDD) en mode hybride.

¶ Formats de Snapshot pour VMFS

Sur le datastore VMFS, le disque delta d’un Snapshot de machine virtuelle est un disque “sparse”.

Les disques delta utilisent différents formats “sparse” selon le type de datastore VMFS.

Le format SEsparse est similaire au VMFSsparse, avec certaines améliorations :

- SEsparse est plus efficace en termes d’espace et prend en charge la récupération d’espace.

- Ce format de disque est recommandé pour les environnements d’infrastructure de bureau virtuel (VDI).

| Format Sparse | Utilisé par VMFS5 | Utilisé par VMFS6 |

|---|---|---|

| VMFSsparse | Oui, pour les disques virtuels de moins de 2 To. | Non. |

| SEsparse (sparse efficace en espace) | Oui, pour les disques virtuels égaux ou supérieurs à 2 To. | Oui, c’est le format par défaut. |

Lorsque vous prenez un Snapshot, l’état du disque virtuel est préservé, empêchant le système d’exploitation invité d’écrire sur le disque.

Un disque delta ou un disque enfant est créé. Le disque delta représente la différence entre l’état actuel du disque virtuel et l’état qui existait lors de la prise du précédent Snapshot.

VMFSsparse est implémenté au-dessus de VMFS.

La couche VMFSsparse traite les opérations d’E/S émises vers un Snapshot de VM.

Techniquement, VMFSsparse est un journal de reprise (redo-log) qui commence vide immédiatement après la prise d’un Snapshot de VM.

Le redo-log s’agrandit jusqu’à la taille de son disque virtuel de base (VMDK) lorsque l’ensemble du VMDK est réécrit avec de nouvelles données après la prise du Snapshot.

Ce redo-log n’est qu’un fichier dans le datastore VMFS.

Après la prise du Snapshot, le VMDK de base attaché à la VM est remplacé par le nouveau VMDK “sparse” créé.

Avec SEsparse, la récupération d’espace permet de marquer les blocs supprimés par le système d’exploitation invité, et des commandes sont envoyées à la couche SEsparse dans l’hyperviseur pour “démapper” ces blocs.

Cette opération aide à récupérer l’espace alloué par SEsparse après la suppression des données par le système invité.

SEsparse est le format de disque recommandé pour les environnements VMware Horizon.

Dans ces environnements, la récupération de l’espace de stockage est essentielle en raison du grand nombre de locataires partageant la même infrastructure.

¶ Migration de vos données de VMFS5 vers VMFS6

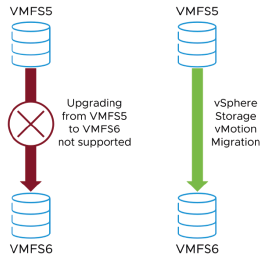

En raison des changements dans les structures de métadonnées de VMFS6, vous ne pouvez pas effectuer de mise à niveau directe de VMFS5 vers VMFS6.

Un datastore VMFS6 ne peut être créé qu’en tant que nouveau datastore.

Utilisez vSphere Storage vMotion pour migrer les données de votre datastore VMFS5 vers un datastore VMFS6.

Pour plus d’informations, consultez cet article de la base de connaissances VMware : kb2147824

¶ QCM : Fonctionnalités de VMFS6

Quelles fonctionnalités de scalabilité et de performance sont disponibles uniquement avec les datastores VMFS6 ?

Sélectionnez toutes les réponses qui s’appliquent.

☐ Prise en charge des disques 4Kn

☐ Temps de création de fichiers plus rapides

☐ SEsparse comme format de snapshot

☐ Taille maximale du datastore : 64 To

☐ Extension à chaud d’un disque virtuel jusqu’à 62 To

☐ Opérations de disque parallèles et transactions concurrentes

¶ Réponses : Fonctionnalités de VMFS6

Quelles fonctionnalités de scalabilité et de performance sont disponibles uniquement avec les datastores VMFS6 ?

✓ Prise en charge des disques 4Kn

✓ Temps de création de fichiers plus rapides

☐ SEsparse comme format de snapshot

☐ Taille maximale du datastore : 64 To

☐ Extension à chaud d’un disque virtuel jusqu’à 62 To

✓ Opérations de disque parallèles et transactions concurrentes

¶ Revue des objectifs d’apprentissage

- Expliquer pourquoi VMFS est un système de fichiers évolutif et à hautes performances.

- Identifier les améliorations de performance de VMFS6 par rapport à VMFS5.

- Décrire la procédure de migration de VMFS5 vers VMFS6.

¶ Leçon 4 : Datastores vSAN

¶ Objectifs d’apprentissage

- Expliquer le but d’un datastore vSAN

- Décrire l’architecture et les exigences de la configuration vSAN

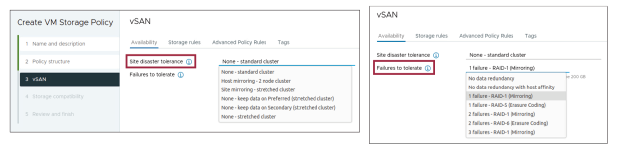

- Expliquer le but des stratégies de stockage vSAN

- Décrire le but des domaines de panne

¶ Architecture de stockage vSAN

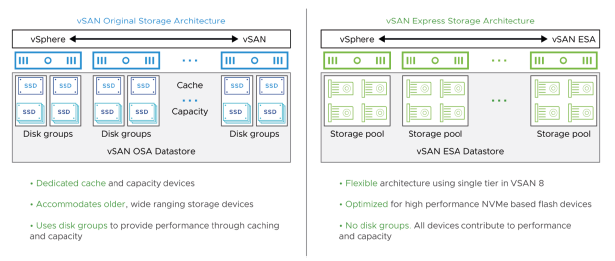

Introduite dans vSAN 8, vSAN Express Storage Architecture (ESA) est une nouvelle architecture de stockage optionnelle sur la plateforme vSAN qui permet d’atteindre de nouveaux niveaux de performance, de scalabilité, de résilience et de simplicité.

¶ vSAN Original Storage Architecture (OSA)

- Cache et périphériques de capacité dédiés

- Prend en charge les anciens périphériques de stockage variés

- Utilise des groupes de disques pour offrir des performances via la mise en cache et la capacité

¶ vSAN Express Storage Architecture (ESA)

- Architecture flexible utilisant un niveau unique dans vSAN 8

- Optimisée pour les périphériques flash NVMe hautes performances

- Aucun groupe de disques — tous les périphériques contribuent aux performances et à la capacité

¶ À propos des datastores vSAN

vSAN est une solution de stockage définie par logiciel qui fournit un stockage partagé pour les clusters vSphere sans utiliser de stockage externe traditionnel.

Un cluster vSAN nécessite :

- Un minimum de trois hôtes faisant partie du cluster vSphere et configurés pour vSAN

- Un réseau vSAN

- Des périphériques de stockage locaux sur chaque hôte, regroupés pour créer un datastore vSAN partagé virtuel

Les datastores vSAN aident les administrateurs à utiliser le stockage défini par logiciel de la manière suivante :

- Stratégie de stockage par machine virtuelle (VM) : avec plusieurs stratégies par datastore, chaque VM peut avoir ses propres capacités de stockage uniques.

- Intégration avec vSphere et vCenter Server : la fonctionnalité vSAN est intégrée et ne nécessite aucun dispositif supplémentaire. Vous créez un cluster vSAN comme vous le feriez avec vSphere HA ou vSphere DRS.

- Stockage évolutif (scale-out) : jusqu’à 64 hôtes ESXi peuvent faire partie d’un cluster. L’extension se fait en ajoutant de nouveaux nœuds au cluster.

- Résilience intégrée : la stratégie de stockage par défaut de vSAN établit une redondance RAID 1 pour toutes les machines virtuelles (VM).

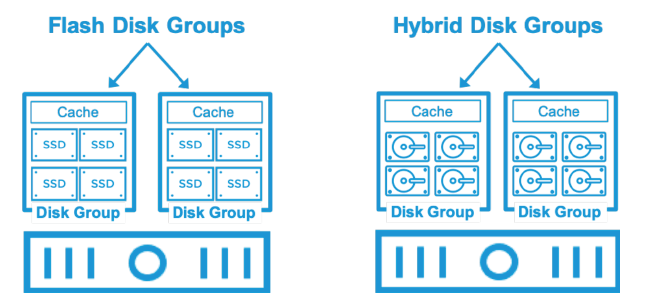

¶ Groupes de disques

Les groupes de disques sont des éléments de gestion vSAN présents sur tous les hôtes ESXi d’un cluster vSAN.

Un hôte peut inclure jusqu’à cinq groupes de disques au maximum.

Les groupes de disques sont combinés pour créer un seul datastore vSAN.

Un groupe de disques nécessite :

- Un périphérique flash pour la mise en cache

- Un à sept périphériques de capacité pour le stockage

vSAN utilise le concept de groupes de disques pour regrouper les périphériques de cache et de capacité au sein d’une même unité de gestion.

Un groupe de disques est un ensemble composé d’un périphérique de cache et de un à sept périphériques de capacité.

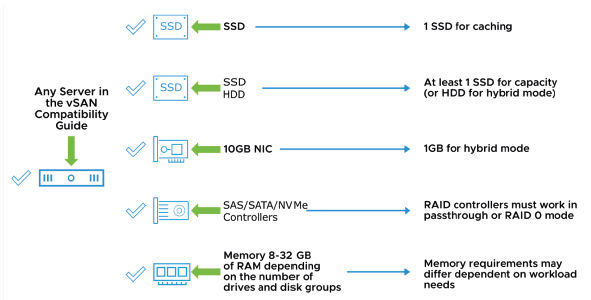

¶ Exigences matérielles de vSAN

Les fonctionnalités de vSAN sont natives à ESXi et ne nécessitent aucun logiciel supplémentaire.

vSAN nécessite plusieurs composants matériels que les hôtes n’ont généralement pas :

-

Un disque SCSI SAS, SSD SATA, ou SSD NVMe, et de un à sept disques magnétiques pour chaque groupe de disques hybride.

-

Un SAS ou SATA SSD, et de un à sept disques flash pour chaque groupe de disques tout-flash.

-

Un réseau dédié de 1 Gbps (10 Gbps recommandé) pour les groupes de disques hybrides.

-

Un réseau dédié de 10 Gbps pour les groupes de disques tout-flash.

Les vitesses de réseau de 1 Gbps entraînent une congestion préjudiciable pour les architectures tout-flash et ne sont pas prises en charge. -

Le réseau vSAN doit être configuré pour IPv4 ou IPv6.

De plus, chaque hôte doit disposer d’un minimum de 32 Go de mémoire afin de pouvoir prendre en charge un maximum de cinq groupes de disques et un maximum de sept périphériques de capacité par groupe de disques.

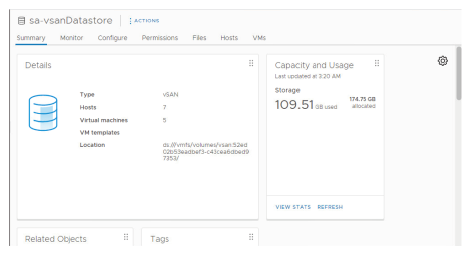

¶ Visualisation du résumé du vSAN Datastore

L’onglet Summary du vSAN datastore affiche les informations générales de configuration de vSAN.

¶ Objets dans les vSAN Datastores

Le stockage vSAN est basé sur les objets et guidé par les politiques.

Les machines virtuelles (VM) créées sur un vSAN datastore incluent les objets suivants :

- Un espace de noms principal de la VM (VM home namespace)

- Un ou plusieurs objets VMDK

- Un objet d’échange (swap) de VM en thin provisioning

- Un ou plusieurs objets de mémoire de VM

Autres objets vSAN :

- Objets de données de performance vSAN

- Objets LUN iSCSI

| Objet vSAN | Fichiers VM traditionnels |

|---|---|

| VM home namespace | .nvram, .vmsd, .vmx, vmx-*.vswp, .log, .hlog |

| VMDK | -flat.vmdk |

| VM swap | .vswp |

| VM memory | .vmem |

| Snapshot delta | -00000#-delta.vmdk, -00000#-sesparse.vmdk |

Un cluster vSAN stocke et gère les données sous forme de conteneurs flexibles appelés objets.

Lors de la création d’une VM sur un vSAN datastore, un ensemble d’objets est généré :

- VM home namespace : Stocke les métadonnées de la machine virtuelle (fichiers de configuration).

- VMDK : Disque de la machine virtuelle.

- VM swap : Fichier d’échange de la machine virtuelle, créé lorsque la VM est mise sous tension.

- VM memory : État mémoire de la machine virtuelle lorsque celle-ci est suspendue ou lorsqu’un snapshot est pris et que l’état mémoire est conservé.

- Snapshot delta : Créé lorsqu’un snapshot de machine virtuelle est pris.

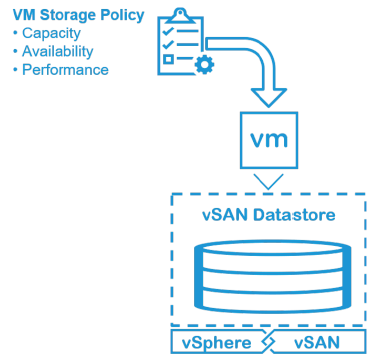

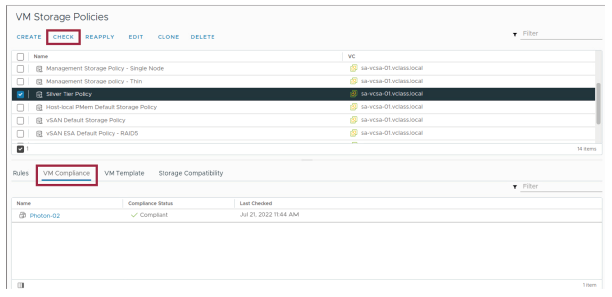

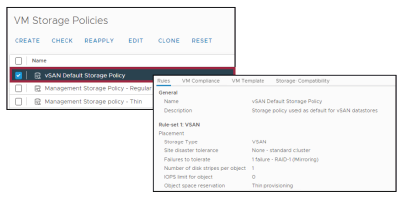

¶ Politiques de stockage des VM

Les politiques de stockage définissent la manière dont les objets inclus dans une machine virtuelle (VM) sont stockés.

Les politiques de stockage présentent les caractéristiques suivantes :

- Basées sur les capacités de stockage

- Définies pour une VM ou un disque au moment du déploiement

- Peuvent être appliquées ultérieurement

- Peuvent être modifiées à tout moment

- Ne peuvent pas être supprimées si elles sont en cours d’utilisation

Les politiques de stockage des VM sont un ensemble de règles que vous configurez pour les machines virtuelles.

Chaque politique de stockage reflète un ensemble de capacités répondant aux exigences de disponibilité, de performance et de stockage de l’application ou de l’accord de niveau de service (SLA) de cette VM.

Il est recommandé de créer les politiques de stockage avant de déployer les machines virtuelles qui en ont besoin.

Vous pouvez appliquer et mettre à jour les politiques de stockage après le déploiement.

Un administrateur vSphere responsable du déploiement des machines virtuelles peut sélectionner des politiques créées en fonction des capacités de stockage.

En fonction de la politique sélectionnée pour l’objet VM, ces capacités sont appliquées au vSAN datastore.

L’objet est créé sur plusieurs hôtes ESXi et groupes de disques pour satisfaire ces politiques.

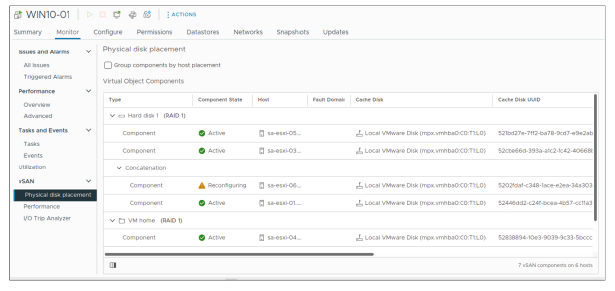

¶ Affichage des paramètres de la VM pour les informations vSAN

La consommation du stockage vSAN est basée sur la politique de stockage de la machine virtuelle (VM).

La vue de placement physique des disques de la VM fournit les informations suivantes :

- État des composants

- Hôte ESXi

- Emplacement des fichiers de disque sur un vSAN datastore

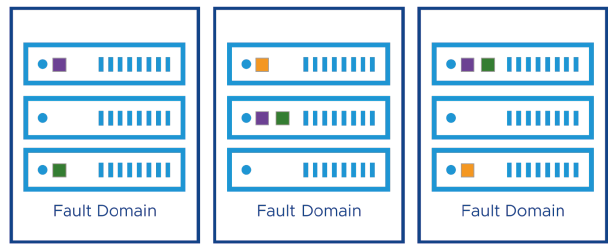

¶ À propos des domaines de défaillance vSAN

Dans vSAN, un domaine de défaillance (fault domain) représente un ensemble de matériel partageant un même point de défaillance potentiel :

- vSAN peut tolérer la défaillance d’un hôte unique, d’un rack complet, d’un commutateur réseau, et plus encore.

- Les objets protégés sont distribués entre différents domaines de défaillance.

Pour plus d’informations sur la gestion et la configuration des domaines de défaillance dans vSAN, consultez Administering VMware vSAN à l’adresse suivante : https://docs.vmware.com/en/VMware-vSphere/8.0/vsan-80-administration-guide.pdf

¶ Configurations de domaines de défaillance

Les domaines de défaillance vSAN sont configurés selon le cas d’utilisation :

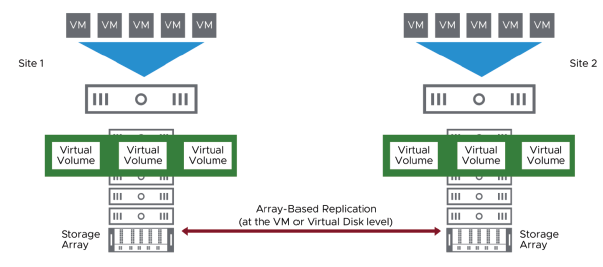

- Cluster étendu (Stretched cluster) : vSAN est configuré sur des hôtes répartis sur plusieurs sites physiques.

- Cluster non étendu (Nonstretched cluster) : plusieurs domaines de défaillance sont créés au sein d’un même cluster.

- Configuration vSAN à deux nœuds (Two-node configuration) : vSAN est configuré avec deux nœuds de données et un nœud témoin (witness) sur un site distinct.

Lors des opérations du cycle de vie, vSphere Lifecycle Manager prend en charge les demandes suivantes :

- Mettre à niveau le cluster étendu vSAN afin que les hôtes du domaine de défaillance préféré soient mis à jour avant ceux du domaine de défaillance secondaire.

- Mettre à niveau le cluster vSAN comportant plusieurs domaines de défaillance de sorte que tous les hôtes d’un domaine de défaillance soient mis à jour avant de passer au domaine suivant.

¶ Lab 10 : Visualiser une configuration de vSAN Datastore

Visualisez une configuration de vSAN datastore et les composants d’une machine virtuelle sur le vSAN datastore :

- Afficher une configuration de vSAN Datastore

- Afficher la politique de stockage par défaut de vSAN

- Afficher une machine virtuelle sur le vSAN Datastore

Retrouvez le lien du Lab en cliquant ici : Lab 10 : Accéder à l'environnement de lab

¶ Revue des objectifs d’apprentissage

- Expliquer le but d’un vSAN datastore

- Décrire l’architecture et les exigences d’une configuration vSAN

- Expliquer le but des politiques de stockage vSAN

- Décrire le but des domaines de défaillance

¶ Leçon 5 : vSphere Storage APIs - Array Integration

¶ Objectifs d’apprentissage

- Décrire comment vSphere Storage APIs - Array Integration aide les baies de stockage à s’intégrer avec vSphere.

- Expliquer comment la récupération d’espace fonctionne avec les VMFS datastores.

¶ À propos de vSphere Storage APIs - Array Integration

Les vSphere Storage APIs - Array Integration aident les fournisseurs de stockage à fournir une assistance matérielle pour accélérer les opérations d’E/S vSphere qui sont plus efficacement réalisées au niveau du matériel de stockage.

Les vSphere Storage APIs - Array Integration constituent un ensemble de protocoles et de fonctionnalités du VMkernel qui prennent en charge l’intégration entre ESXi et les baies de stockage :

- Grâce aux APIs d’accélération matérielle, les baies peuvent s’intégrer à vSphere pour déléguer de manière transparente certaines opérations de stockage au matériel.

- Les APIs de provisionnement fin (thin provisioning) aident à éviter les conditions de manque d’espace et à exécuter la récupération d’espace.

Les vSphere Storage APIs - Array Integration sont une famille d’APIs utilisées par des fournisseurs tiers de matériel, de logiciels et de stockage pour développer des composants qui améliorent plusieurs fonctionnalités et solutions de vSphere.

Dans un environnement virtualisé, les disques virtuels sur un VMFS datastore ne peuvent pas être interprétés par la baie de disques ; le VMFS datastore ne peut donc pas utiliser les fonctions matérielles par machine virtuelle ou par fichier de disque virtuel.

Les plug-ins vSphere Storage APIs - Array Integration peuvent améliorer les performances de transfert de données et sont transparents pour l’utilisateur final.

¶ APIs d’accélération matérielle pour le stockage en blocs

Grâce aux APIs d’accélération matérielle, l’hôte ESXi peut déléguer certaines opérations spécifiques de gestion de machines virtuelles (VM) et de stockage au matériel de stockage :

- L’utilisation de ces APIs réduit considérablement la charge CPU sur l’hôte.

- Les périphériques de stockage en blocs, tels que Fibre Channel et iSCSI, prennent en charge l’accélération matérielle.

- L’accélération matérielle pour les périphériques de stockage en blocs prend en charge plusieurs opérations de baie (array operations).

| Array Operation | Cas d’utilisation |

|---|---|

| Full copy, aussi appelé clone blocks, copy offload ou XCOPY | Utilisé par vSphere Storage vMotion, pour le clonage de VMs et le déploiement d’une VM à partir d’un modèle |

| Block zeroing, aussi appelé write same | Utilisé lors de la création de disques virtuels épais avec eager-zeroed |

| Hardware-assisted locking, aussi appelé atomic test and set | Améliore les performances lors des modifications de métadonnées VMFS |

Avec l’assistance du matériel de stockage, l’hôte exécute les opérations de baie plus rapidement, tout en consommant moins de CPU, de mémoire et de bande passante du réseau de stockage.

L’accélération matérielle ESXi pour les périphériques de stockage en blocs prend en charge les opérations suivantes :

-

Full copy : les baies de stockage peuvent effectuer des copies complètes des données directement au sein de la baie. L’hôte n’a pas besoin de lire et d’écrire les données. Cette opération réduit le temps et la charge réseau lors du clonage de VMs, du provisionnement à partir d’un modèle ou lors d’une migration avec vSphere Storage vMotion.

-

Block zeroing : les baies de stockage peuvent mettre à zéro plusieurs blocs afin de fournir un espace de stockage nouvellement alloué, libre de toute donnée précédente. Cette opération réduit le temps et la charge réseau lors de la création de VMs ou du formatage de disques virtuels. Elle est activée lorsque l’option Thick Provision Eager Zero est utilisée pour un disque.

-

Hardware-assisted locking : cette option prend en charge le verrouillage granulaire des VMs sans utiliser de réservations SCSI. Le verrouillage des disques s’effectue par secteur, contrairement aux réservations SCSI qui verrouillent l’ensemble du LUN (Logical Unit Number).

Les fonctionnalités d’accélération matérielle sont activées par défaut et utilisées sur les baies de stockage qui les prennent en charge.

Il est possible de désactiver ces fonctionnalités, mais ce n’est pas recommandé.

Les anciennes baies ou celles disposant d’un firmware obsolète peuvent ne pas prendre en charge l’accélération matérielle. Dans ce cas, l’hôte doit recourir à des techniques plus anciennes et plus gourmandes en CPU pour effectuer les mêmes tâches.

Pour plus d’informations sur vSphere Storage APIs - Array Integration, consultez l’article VMware de la base de connaissances : VMware KB 1021976.

¶ Accélération matérielle pour NAS

Avec l’accélération matérielle pour le Network-Attached Storage (NAS), les baies NAS peuvent s’intégrer à vSphere pour déléguer certaines opérations de stockage, comme le clonage hors ligne, directement à la baie.

Cette intégration réduit la charge CPU sur l’hôte.

L’accélération matérielle pour NAS prend en charge les opérations NAS suivantes :

- Full file clone : le fichier entier, et non des segments de fichier, est cloné.

- Reserve space : l’espace pour un disque virtuel est alloué en format épais (thick).

- Native Snapshot support : VMware Horizon peut déléguer la création de linked clones à une baie NAS.

- Extended file statistics

Avec l’accélération matérielle, l’hôte peut s’intégrer aux périphériques NAS et utiliser plusieurs opérations matérielles que le stockage NAS met à disposition :

- Full file clone : cette opération est similaire au clonage de blocs VMFS, sauf que les baies NAS clonent des fichiers entiers au lieu de segments de fichiers.

- Reserve space : les baies de stockage allouent l’espace pour un fichier de disque virtuel en format épais (thick).

En général, lorsque vous créez un disque virtuel sur un NFS datastore, le serveur NAS détermine la politique d’allocation.

La politique d’allocation par défaut sur la plupart des serveurs NAS est fine (thin) et ne garantit pas un espace de stockage réservé pour le fichier.

Cependant, l’opération reserve space peut instruire le périphérique NAS d’utiliser des mécanismes spécifiques au fournisseur pour réserver de l’espace pour un disque virtuel.

Ainsi, vous pouvez créer des disques virtuels épais sur le NFS datastore. - Native Snapshot support : cette opération permet à View (Horizon) de déléguer la création de linked clones à une baie NAS.

- Extended file statistics : les baies de stockage peuvent rapporter avec précision l’utilisation de l’espace.

L’accélération matérielle pour NAS est mise en œuvre à l’aide de plug-ins NAS spécifiques aux fournisseurs.

Ces fournisseurs créent et maintiennent généralement ces plug-ins, puis les distribuent sous forme de vSphere Installation Bundles (VIBs) via une page Web.

¶ API de Thin Provisioning pour les baies de stockage

Avec les Array Thin Provisioning APIs, un hôte peut s’intégrer au stockage physique et détecter l’utilisation de l’espace dans les LUNs à provisionnement fin (thin-provisioned).

-

Un VMFS datastore déployé sur un LUN à provisionnement fin ne peut détecter que la taille logique du LUN.

Par exemple, si une baie indique 2 To d’espace de stockage mais ne fournit en réalité qu’1 To, le datastore considérera 2 To comme la taille du LUN. -

En utilisant l’intégration de thin provisioning, l’hôte peut effectuer les tâches suivantes :

-

Surveiller l’utilisation de l’espace sur les LUNs thin-provisioned afin d’éviter un manque d’espace physique.

-

Informer la baie de l’espace du datastore libéré lorsque les actions suivantes se produisent :

- Les disques virtuels et les fichiers de machines virtuelles sont supprimés du datastore.

- Les disques virtuels et les fichiers de machines virtuelles sont migrés hors du datastore via vSphere Storage vMotion.

- Les VM Snapshots sont supprimés et consolidés.

-

Les LUNs traditionnels présentés à l’hôte ESXi par les baies de stockage sont à provisionnement fixe (thick-provisioned).

L’espace physique nécessaire pour chaque LUN est entièrement alloué à l’avance.

ESXi prend également en charge les LUNs thin-provisioned.

Lorsqu’un LUN est à provisionnement fin, la baie de stockage indique la taille logique du LUN, qui peut être supérieure à la capacité physique réelle sous-jacente.

Lorsque le datastore s’étend ou lorsque vSphere Storage vMotion est utilisé pour migrer des machines virtuelles vers un LUN thin-provisioned, les Array Thin Provisioning APIs permettent à l’hôte de communiquer avec le LUN.

L’hôte peut alors émettre des avertissements en cas de dépassement de la capacité physique ou de conditions de manque d’espace.

Aucune étape d’installation n’est requise pour les extensions d’array thin provisioning.

Le thin provisioning des baies fonctionne sur tous les volumes VMFS5 et VMFS6.

Le micrologiciel des périphériques (firmware) activé pour cette API doit prendre en charge les fonctionnalités de thin provisioning.

ESXi vérifie en permanence la compatibilité du firmware avec les fonctionnalités de array thin provisioning.

Après la mise à jour du firmware, ESXi commence automatiquement à utiliser ces fonctionnalités.

¶ À propos de la récupération d’espace

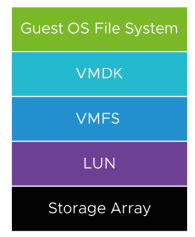

Dans un environnement virtualisé, différents niveaux d’abstraction existent au niveau de la couche de stockage :

- Les fichiers utilisateurs résident dans la couche du système d’exploitation invité (Guest OS). Le système d’exploitation invité gère ces fichiers.

- Le système d’exploitation invité (Guest OS) réside dans le fichier VMDK, qui est géré par le VMFS datastore.

- Le VMFS datastore réside sur le LUN, qui est présenté comme périphérique de stockage à l’hôte ESXi.

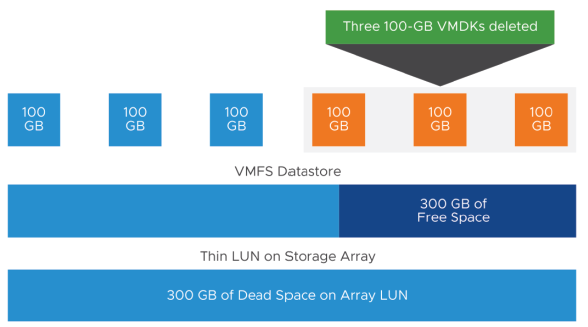

Les données sont supprimées du VMFS datastore de la manière suivante :

- Les données sont supprimées à partir du système d’exploitation invité (guest OS).

- Un fichier VMDK est supprimé du datastore.

Dans les deux cas, l’espace sur la baie (array) n’est pas libéré.

Cet espace est appelé espace mort ou espace sale.

La baie ne peut pas réutiliser cet espace, sauf si une commande lui indique de le faire, comme la commande SCSI UNMAP.

Supprimer ou retirer des fichiers d’un VMFS datastore libère de l’espace au sein du système de fichiers.

Cet espace libre reste associé au périphérique de stockage jusqu’à ce que le système de fichiers le libère ou l’unmappe.

¶ Récupération d’espace avec VMFS

ESXi prend en charge la récupération d’espace libre.

Lorsque vous exécutez la commande SCSI unmap, un hôte ESXi informe la baie de stockage qu’elle peut récupérer l’espace libre :

- Avec un VMFS5 datastore, vous pouvez envoyer manuellement la commande

unmapà l’aide de la commandeesxcli. - Avec un VMFS6 datastore, l’hôte ESXi envoie automatiquement la commande

unmapà la baie de stockage.

| Fonctionnalité | VMFS5 | VMFS6 |

|---|---|---|

| Récupération d’espace automatique | Non | Oui |

| Récupération d’espace manuelle via ESXCLI | Oui | Oui |

Lorsque vous exécutez la commande unmap, un hôte ESXi informe la baie de stockage que les fichiers de machine virtuelle (VM files) ont été supprimés ou retirés d’un VMFS datastore en thin provisioning.

Suite à cette notification, la baie peut récupérer les blocs libérés.

¶ Effectuer une récupération d’espace manuelle sur un VMFS5 Datastore

Pour récupérer manuellement de l’espace sur un VMFS5 datastore, vous pouvez exécuter la commande esxcli suivante : esxcli storage vmfs unmap

Vous pouvez automatiser ce processus en utilisant cette commande dans un script PowerCLI et en planifiant l’exécution du script en dehors des heures de pointe.

| Option de commande | Description | |

|---|---|---|

| -l / --volume-label=volume_label | Le label du volume VMFS à désassocier (unmap). Argument obligatoire. Utilisez soit l’option -l, soit l’option -u, mais pas les deux. | |

| -u / --volume-uuid=volume_uuid | L’UUID du volume VMFS à désassocier. Argument obligatoire. Utilisez soit l’option -l, soit l’option -u, mais pas les deux. | |

| -n / --reclaim-unit=number | Nombre de blocs VMFS à désassocier par itération. Argument optionnel. La valeur par défaut est 200. |

Sur les VMFS5 datastores, vous devez exécuter manuellement la commande : esxcli storage vmfs unmap.

Le serveur cible vous demande un nom d’utilisateur et un mot de passe.

D’autres options de connexion, comme un fichier de configuration ou un fichier de session, sont également prises en charge.

Cette commande peut être exécutée sans fenêtre de maintenance :

- Vous pouvez spécifier la taille de récupération en blocs plutôt qu’en pourcentage, ce qui rend le calcul de la taille de récupération plus intuitif.

- L’espace inutilisé (“dead space”) est récupéré par incréments, plutôt que tout en une seule fois, afin d’éviter d’éventuels problèmes de performance.

Lorsque vous exécutez cette commande, elle peut envoyer plusieurs requêtes unmap simultanément, ce qui peut temporairement bloquer certaines ressources pendant l’opération.

Pour plus d’informations sur cette commande, consultez la documentation vSphere Storage : https://docs.vmware.com/en/VMware-vSphere/8.0/vsphere-esxi-vcenter-80-storage-guide.pdf

¶ Activer la récupération d’espace automatique sur un VMFS6 Datastore

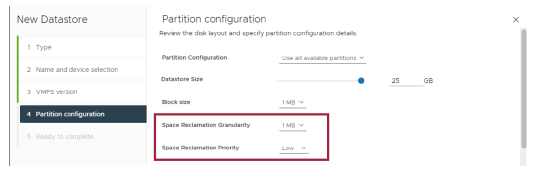

Lorsque vous créez un VMFS6 datastore, vous pouvez modifier les paramètres par défaut pour la récupération d’espace asynchrone automatique :

-

Space Reclamation Granularity : définit la taille d’unité utilisée pour la commande UNMAP. La valeur par défaut est 1 MB.

-

Space Reclamation Priority : contrôle la vitesse à laquelle les blocs supprimés ou désassociés (unmapped) sont récupérés sur les LUNs qui soutiennent le datastore.

La priorité par défaut est Low, ce qui correspond à un taux UNMAP de 25 MBps.

Par défaut, la granularity (granularité) de récupération d’espace est égale à la taille de bloc, c’est-à-dire 1 MB. Les secteurs de stockage plus petits que 1 MB ne sont pas récupérés.

Par défaut également, la LUN exécute l’opération de récupération d’espace à un rythme faible.

Vous pouvez aussi définir la space reclamation priority sur None pour désactiver cette opération pour le datastore.

¶ Configurer le taux automatique d’UNMAP

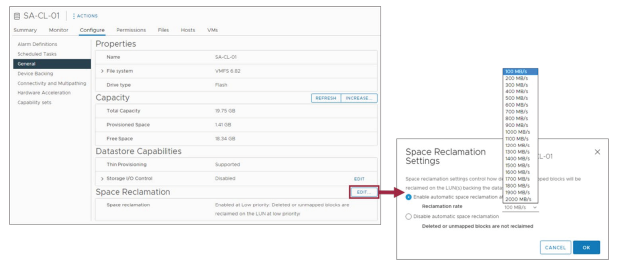

Introduit dans vSphere 6.7, vous pouvez définir un taux UNMAP fixe pour le datastore.

Le taux UNMAP correspond à la vitesse à laquelle les commandes automatiques UNMAP sont traitées.

Vous pouvez modifier ce taux UNMAP pour l’adapter aux capacités de la baie de stockage (storage array).

¶ Prise en charge de la récupération d’espace pour les systèmes d’exploitation invités

Les VMFS5 et VMFS6 datastores prennent tous deux en charge la commande UNMAP émise par le système d’exploitation invité.

Certains systèmes d’exploitation invités, tels que Windows Server 2012 R2, peuvent envoyer des commandes UNMAP à la baie.

Les commandes UNMAP de l’invité sont traduites et transmises à la baie, qui peut alors récupérer l’espace libéré.

Pour les fichiers VMDK à provisionnement fin (thin-provisioned), l’espace disque virtuel diminue de la quantité d’espace récupérée.

ESXi prend en charge les commandes UNMAP émises directement depuis un système d’exploitation invité pour récupérer de l’espace de stockage.

VMFS5 prend en charge les requêtes automatiques de récupération d’espace pour un nombre limité de systèmes d’exploitation invités.

Pour envoyer des requêtes UNMAP depuis le système d’exploitation invité vers la baie, la machine virtuelle (VM) doit remplir les conditions préalables suivantes :

- Le disque virtuel doit être en provisionnement fin (thin-provisioned).

- Le système d’exploitation invité doit être capable d’identifier le disque virtuel comme étant à provisionnement fin.

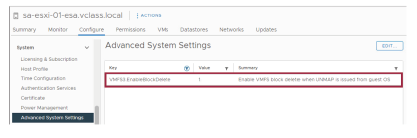

- Le paramètre avancé de l’hôte ESXi “EnableBlockDelete” doit être défini sur 1.

Avec VMFS6, utilisez le paramètre Space Reclamation Priority sur le datastore.

L’option EnableBlockDelete est ignorée.

Lorsque vous utilisez la récupération d’espace avec des datastores VMFS6, la considération suivante s’applique :

- VMFS6 traite la requête UNMAP provenant du système d’exploitation invité uniquement lorsque l’espace à récupérer est égal à 1 Mo ou à un multiple de 1 Mo.

VMFS6 prend généralement en charge les requêtes automatiques de récupération d’espace provenant des systèmes d’exploitation invités et transmet ces requêtes à la baie.

De nombreux systèmes d’exploitation invités peuvent envoyer la commande UNMAP sans nécessiter de configuration supplémentaire.

Les systèmes d’exploitation invités qui ne prennent pas en charge les UNMAP automatiques peuvent nécessiter une intervention manuelle.

Pour obtenir des informations sur les systèmes d’exploitation invités qui prennent en charge la récupération automatique d’espace sur VMFS6, contactez votre fournisseur.

¶ Copie étendue (XCOPY)

Introduit avec vSphere 8 Update 1, ESXi prend désormais en charge la fonction Extended Copy (XCOPY) entre des datastores situés sur différentes baies de stockage.

XCOPY optimise la copie de données entre des datastores hébergés sur différentes baies de stockage.

Les administrateurs ont maintenant la possibilité de déléguer (offload), migrer et cloner des charges de travail directement vers leurs baies de stockage.

Bien que vSphere 8 U1 active cette fonctionnalité, la migration réelle des données entre les baies doit être prise en charge du côté de la baie de stockage.

¶ QCM : vSphere Storage APIs – Intégration avec les baies

Quelles actions s’appliquent à un hôte ESXi qui utilise des périphériques de stockage prenant en charge les vSphere Storage APIs – Array Integration ?

(Sélectionnez toutes les réponses applicables.)

☐ Informer la baie de stockage qu’elle peut récupérer l’espace libre dans un datastore VMFS.

☐ Déléguer certaines opérations de stockage, telles que le clonage hors ligne, à une baie NAS.

☐ Récupérer des informations sur une baie de stockage, telles que sa topologie et ses capacités.

☐ Déléguer certaines opérations de stockage à un périphérique de stockage en mode bloc, tel que Fibre Channel ou iSCSI.

¶ Réponses : vSphere Storage APIs – Intégration avec les baies

Quelles actions s’appliquent à un hôte ESXi qui utilise des périphériques de stockage prenant en charge les vSphere Storage APIs – Array Integration ?

(Sélectionnez toutes les réponses applicables.)

✓ Informer la baie de stockage qu’elle peut récupérer l’espace libre dans un datastore VMFS.

✓ Déléguer certaines opérations de stockage, telles que le clonage hors ligne, à une baie NAS.

☐ Récupérer des informations sur une baie de stockage, telles que sa topologie et ses capacités.

✓ Déléguer certaines opérations de stockage à un périphérique de stockage en mode bloc, tel que Fibre Channel ou iSCSI.

¶ Revue des objectifs d’apprentissage

- Décrire comment les vSphere Storage APIs – Array Integration aident les baies de stockage à s’intégrer avec vSphere.

- Expliquer comment fonctionne la récupération d’espace (space reclamation) avec les datastores VMFS.

¶ Leçon 6 : vSphere Storage APIs for Storage Awareness et vSphere APIs for I/O Filtering (VASA et VAIO)

¶ Objectifs d’apprentissage

- Décrire comment l’API vSphere for Storage Awareness (VASA) garantit que les exigences de stockage d’une machine virtuelle (VM) sont respectées.

- Expliquer comment les fournisseurs peuvent créer des services de données pour les VMs en utilisant les vSphere APIs for I/O Filtering (VAIO).

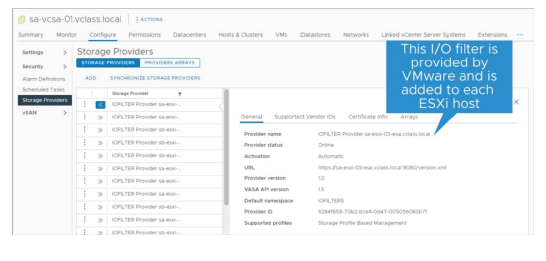

¶ À propos de vSphere API for Storage Awareness

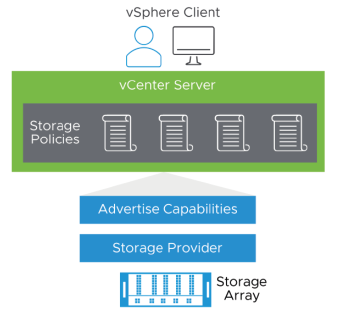

Avec vSphere API for Storage Awareness, un fournisseur de stockage peut développer un composant logiciel appelé storage provider pour ses baies de stockage.

Grâce à cette API, un storage provider obtient des informations sur la topologie, les capacités et l’état du stockage disponible dans la baie.

vCenter se connecte au storage provider. Les informations issues de ce fournisseur apparaissent dans le vSphere Client.

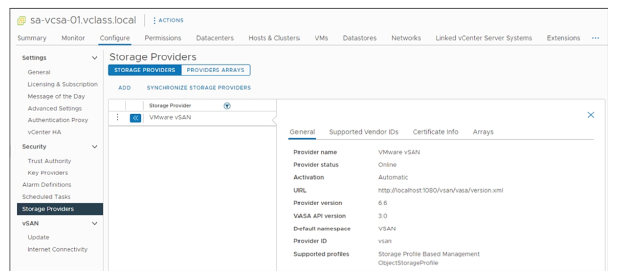

Naviguez dans vCenter > onglet Configure > Storage Providers

Dans vCenter, les administrateurs vSphere ne peuvent pas accéder directement aux capacités de stockage du LUN sur lequel leurs machines virtuelles (VMs) sont stockées.

Les VMs sont approvisionnées sur un “storage black box” : les administrateurs ne voient qu’un identifiant de LUN, comme un NAA ID (Network Address Authority ID) ou un identifiant T10.

Un fournisseur de stockage peut utiliser vSphere API for Storage Awareness pour fournir des informations détaillées sur le LUN.

Le storage provider est développé par le fournisseur de la baie de stockage.

Ce provider peut résider soit sur le processeur de la baie de stockage, soit sur une appliance virtuelle — le choix revient au fournisseur.

vCenter se connecte ensuite à ce provider pour obtenir des informations sur la topologie, les capacités et l’état du LUN.

Ces informations sont affichées dans le vSphere Client.

Un storage provider peut fournir des informations sur un ou plusieurs périphériques de stockage.

Il peut prendre en charge des connexions vers une seule instance de vCenter ou vers plusieurs instances.

¶ Avantages des Storage Providers

Les storage providers fournissent aux administrateurs vSphere des informations sur la topologie, les capacités et l’état des LUNs utilisés pour leurs machines virtuelles (VMs).

Les administrateurs peuvent utiliser ces informations de plusieurs façons :

- Pour surveiller l’état de santé et l’utilisation de leurs LUNs.

- Pour configurer les VM storage policies avec le stockage adéquat en termes d’espace, de performance et de respect des accords de niveau de service (SLA).

Un storage provider fournit des informations de capacités concernant la configuration du stockage, son état et les services de données disponibles dans l’environnement.

vSphere Storage DRS utilise ces informations pour effectuer le placement et la migration des VMs de manière compatible avec le système de stockage.

Un storage provider fournit notamment les informations suivantes :

-

Storage capabilities : Informations sur les caractéristiques et services du stockage, tels que le nombre et le type de disques utilisés pour un LUN, les opérations d’E/S en mégaoctets par seconde, le type de compression appliqué, et si le format thick-provisioned est utilisé.

-

Storage status : État des entités de stockage ainsi que les alarmes et événements liés aux changements de configuration.

¶ Catégories de Storage Providers

En général, vCenter et ESXi utilisent des storage providers pour obtenir des informations sur la configuration, l’état et les services de données du stockage dans votre environnement.

¶ Persistence Storage Providers :

-

Gèrent les baies et les abstractions de stockage.

-

Peuvent fournir des services de données, tels que la réplication basée sur la baie.

-

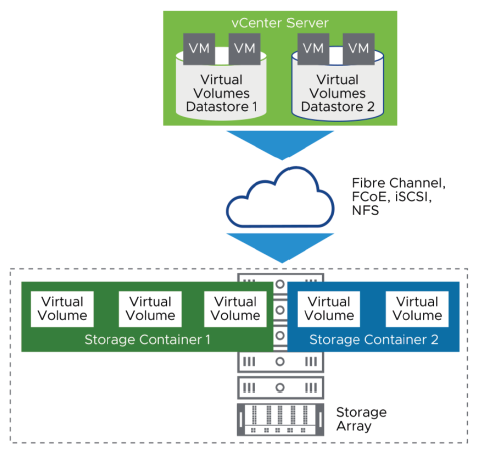

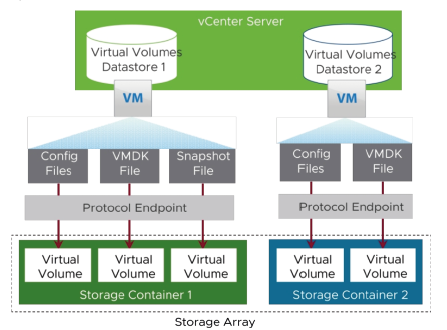

Exemples :

- vSAN storage provider

- vSphere Virtual Volumes storage provider

¶ Data Service Providers :

-

Appelés également I/O filter storage providers ou data service providers.

-

Exemples :

- Mise en cache basée sur l’hôte (Host-based caching)

- Compression

- Encryption

Les persistence storage providers et les data service providers peuvent appartenir à l’une des catégories suivantes :

¶ Built-in Storage Providers :

-

Fournis par VMware.

-

En général, ils ne nécessitent pas d’enregistrement.

-

Exemples :

- Les storage providers prenant en charge vSAN ou les I/O filters sont intégrés et s’enregistrent automatiquement.

¶ Third-party Storage Providers :

-

Fournis par un tiers et nécessitent généralement un enregistrement manuel.

-

Exemples :

- vSphere Virtual Volumes storage provider

- vSphere APIs for Storage Awareness storage providers

¶ Enregistrement d’un Storage Provider

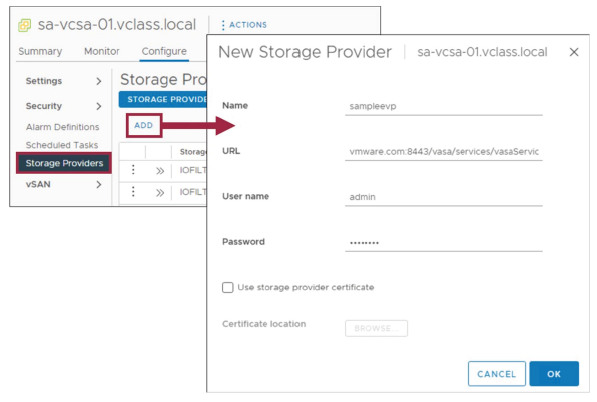

Dans le vSphere Client, sélectionnez Configure > Storage Providers pour enregistrer et gérer un storage provider.

Depuis le panneau Storage Providers, vous pouvez enregistrer un storage provider. Toutes les capacités de stockage du système présentées par le storage provider apparaissent ensuite dans le vSphere Client.

Pour enregistrer un storage provider, le fournisseur de stockage (storage vendor) doit fournir une URL, un compte de connexion et un mot de passe.

Les utilisateurs se connectent au provider pour obtenir les informations sur la baie (array information).

Le vCenter doit faire confiance à l’hôte du provider, donc un certificat de sécurité provenant du provider doit être installé sur le système vCenter.

Pour plus d’informations sur la procédure d’enregistrement des Storage Providers, consultez : VMware Docs – Register Storage Providers

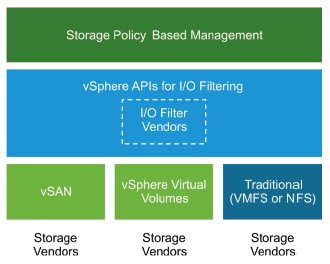

¶ À propos des vSphere APIs pour le filtrage I/O

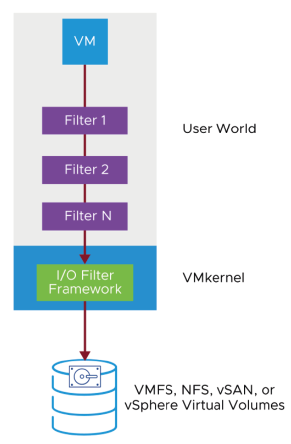

Les vSphere APIs for I/O Filtering (VAIO) fournissent un cadre permettant de créer et d’implémenter des filtres d’E/S (I/O filters) dans le flux de données d’une machine virtuelle (VM) :

- Les filtres d’E/S interceptent et modifient les opérations I/O du disque de la VM dans le VMkernel, avant que les données ne soient transférées vers ou depuis le stockage physique.

- Les filtres d’E/S sont indépendants de la topologie de stockage.

Avec VAIO, VMware et les fournisseurs tiers peuvent créer des services de données, tels que la mise en cache (caching) et la réplication (replication).

Les filtres d’E/S peuvent accéder directement au chemin d’E/S de la VM. Vous pouvez activer un filtre d’E/S pour un disque virtuel individuel.

VMware propose certaines catégories de filtres d’E/S. De plus, des fournisseurs tiers peuvent créer leurs propres filtres. En général, ces filtres d’E/S sont distribués sous forme de packages qui incluent un programme d’installation pour déployer les composants du filtre sur vCenter et les hôtes ESXi du cluster.

Les filtres d’E/S peuvent prendre en charge tous les types de datastores suivants :

- VMFS

- NFS 3

- NFS 4.1

- vSphere Virtual Volumes

- vSAN

¶ Types de filtres d’E/S (I/O Filters)

Les types de filtres d’E/S pouvant être appliqués aux machines virtuelles (VM) sont regroupés par catégories de filtres.

| Catégorie | Exemples |

|---|---|

| Replication (Réplication) | Réplique toutes les opérations d’écriture E/S vers une cible externe, comme un autre hôte ou un cluster. |

| Encryption (Chiffrement) | Fournit des mécanismes de chiffrement pour les machines virtuelles. |

| Caching (Mise en cache) | Met en œuvre une mémoire cache pour les données des disques virtuels. |

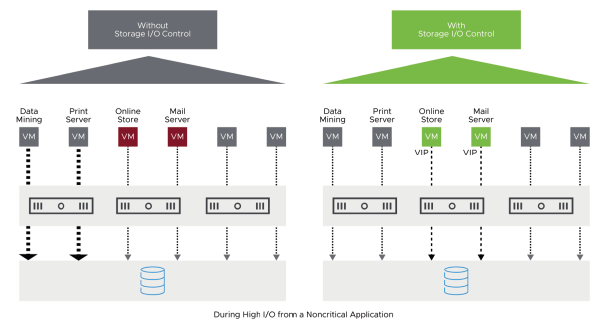

| Storage I/O Control (Contrôle des E/S de stockage) | Donne la priorité aux opérations d’E/S de stockage attribuées aux VMs lors de périodes de contention d’E/S. |

VMware fournit certaines catégories de filtres d’E/S installés sur vos hôtes ESXi.

De plus, les partenaires VMware peuvent créer leurs propres filtres d’E/S via les vSphere APIs for I/O Filtering dans le cadre du programme de développement.

Les filtres d’E/S peuvent remplir plusieurs fonctions selon leur conception et leur objectif.

¶ Fonctionnement des filtres d’E/S

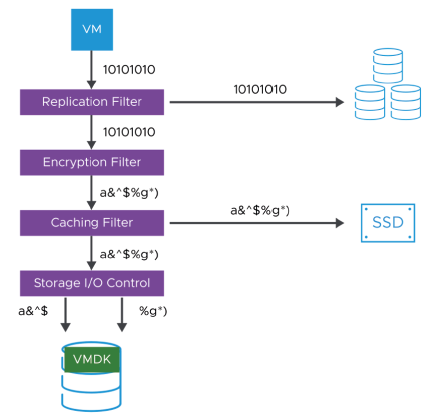

Le framework de filtre d’E/S au sein du VMkernel est responsable de l’interception des E/S et de l’application des filtres associés à une machine virtuelle (VM).

Les filtres d’E/S s’exécutent dans le VM user world afin de garantir que tout problème lié à un filtre affecte uniquement la VM et non l’ensemble de l’hôte.

Les filtres fonctionnent en interceptant les données dans le VMkernel avant que celles-ci ne soient envoyées vers le stockage physique.

Le framework de filtre d’E/S existe en dehors de la couche SCSI virtuelle, ce qui signifie que les E/S hors ligne vers le disque (c’est-à-dire les modifications effectuées lorsque la VM est éteinte) peuvent également être interceptées.

Le framework définit quels filtres doivent être appliqués et dans quel ordre.

Les filtres d’E/S s’exécutent dans le VM’s user world.

Un world est un contexte d’exécution planifié sur un processeur.

Un world est similaire à un processus dans les systèmes d’exploitation conventionnels.

Le framework de filtre d’E/S applique les filtres d’E/S dans l’ordre suivant :

- Réplication

- Chiffrement

- Mise en cache

- Contrôle des E/S de stockage

L’ordre dans lequel les E/S passent à travers ces catégories de filtres est prédéfini.

Cet ordre, tel qu’illustré sur la diapositive, est important — en particulier si vous prévoyez de mettre en œuvre un filtre de réplication et un filtre de chiffrement.

Les données passent par les filtres dans cet ordre prédéfini avant d’être transférées vers le stockage où résident les fichiers ou objets de la VM.

Vous pouvez installer plusieurs filtres appartenant à la même catégorie sur votre hôte ESXi.

Cependant, une seule instance de filtre d’une même catégorie peut être appliquée à un disque virtuel donné.

Comme le filtre de réplication s’exécute avant le filtre de chiffrement, les données répliquées le sont en texte clair.

Des mesures de sécurité supplémentaires doivent donc être prises pour protéger ces transmissions et les données présentes sur la cible de réplication.

¶ Fournisseurs de filtres d’E/S

ESXi dispose de filtres d’E/S préinstallés :

- VM encryption

- Storage I/O Control

Les filtres d’E/S tiers doivent être installés selon les instructions du fournisseur.

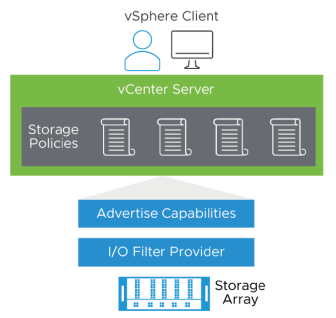

Une fois les filtres d’E/S installés sur les hôtes ESXi, le framework de filtre d’E/S configure et enregistre un fournisseur de stockage, également appelé IOFilter provider, pour chaque hôte.

Le fournisseur IOFilter annonce les nouvelles capacités de filtre d’E/S à vCenter.

Vous pouvez utiliser ces capacités pour créer des politiques de stockage (Storage Policies).

Les fournisseurs de stockage pour le filtrage d’E/S sont des composants logiciels de vSphere.

Ces fournisseurs s’intègrent avec les filtres d’E/S et rapportent à vCenter les capacités de service de données prises en charge par les filtres d’E/S.

Si vous utilisez des filtres d’E/S fournis par des tiers, vous devez installer les filtres d’E/S dans un cluster d’hôtes ESXi.

Vous ne pouvez pas installer les filtres sur des hôtes individuels.

Les packages de filtres sont généralement distribués sous forme de VIBs (VMware Installation Bundles), qui peuvent inclure des démons de filtres d’E/S, des fournisseurs CIM et d’autres composants associés.

En général, pour déployer les filtres, vous exécutez les installateurs fournis par les vendeurs.

Les capacités renseignent le volet VM Storage Policies dans le vSphere Client et peuvent être référencées dans une politique de stockage VM.

Vous appliquez cette politique aux disques virtuels afin que les filtres d’E/S puissent traiter les opérations d’E/S des disques.

¶ Affichage des informations sur les fournisseurs de filtres d’E/S

Pour afficher les fournisseurs de filtres d’E/S pour chaque hôte, sélectionnez l’objet vCenter dans l’inventaire, puis sélectionnez : Configure > Storage Providers

¶ Revue des objectifs d’apprentissage

- Décrire comment vSphere API for Storage Awareness garantit que les exigences de stockage d’une VM sont respectées.

- Expliquer comment les fournisseurs peuvent créer des services de données pour les machines virtuelles (VMs) en utilisant les vSphere APIs for I/O Filtering.

¶ Leçon 7 : Vue d’ensemble de la gestion basée sur les stratégies de stockage

¶ Objectifs d’apprentissage

- Décrire la gestion basée sur les stratégies de stockage (Storage Policy Based Management – SPBM).

- Identifier les catégories de règles de stratégies de stockage.

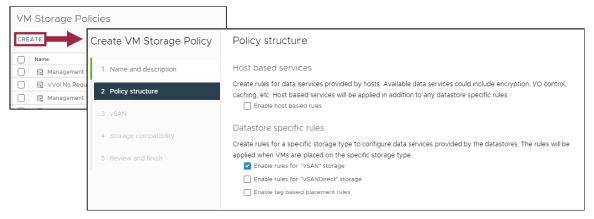

¶ À propos de la gestion basée sur les stratégies de stockage

La gestion basée sur les stratégies de stockage (SPBM) garantit que les machines virtuelles (VMs) utilisent un stockage qui offre un niveau spécifié de capacité, de performance, de disponibilité, de redondance, et ainsi de suite.

SPBM regroupe et abstrait les services de stockage et de données fournis par vSAN, vSphere Virtual Volumes, les I/O Filters, ou encore le stockage traditionnel.

Les partenaires VMware et les fournisseurs de stockage peuvent prendre en charge ces services de stockage et de données.

Au lieu d’intégrer chaque fournisseur ou type de service de stockage individuellement, la SPBM fournit un cadre universel pour de nombreux types d’entités de stockage.

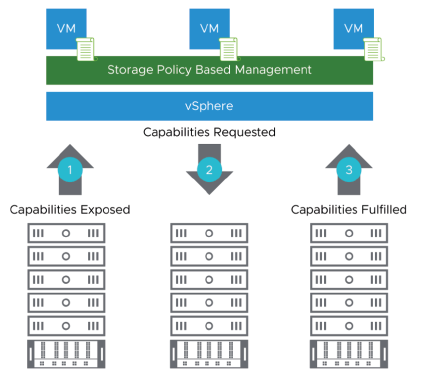

Lorsqu’une application doit être provisionnée, vSphere utilise le module Storage Policy Based Management pour faire correspondre les exigences de la stratégie aux capacités configurées des conteneurs de stockage.

De cette manière, vSphere détermine où les fichiers VMDK doivent être placés.

La gestion basée sur les stratégies de stockage (Storage Policy Based Management – SPBM) présente les fonctionnalités suivantes :

- Publication des capacités de stockage et des services de données que les baies de stockage et les I/O filters fournissent

- Communication bidirectionnelle entre ESXi et vCenter d’un côté, et les baies de stockage et I/O filters de l’autre

- Provisionnement des VM basé sur les stratégies de stockage des machines virtuelles

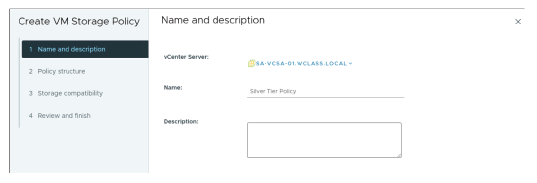

Les stratégies de stockage des VM réduisent la quantité de planification de stockage nécessaire pour chaque VM.

Par exemple, vous pouvez utiliser ces stratégies pour créer des niveaux de stockage (storage tiers) de base.

Les datastores présentant des capacités similaires sont regroupés en catégories telles que Gold, Silver et Bronze.

- Un stockage redondant et haute performance peut être étiqueté Gold tier.

- Un stockage non redondant avec performance moyenne peut être étiqueté Bronze tier.

Les capacités exposées peuvent inclure la performance, la capacité, la protection, etc.

Les capacités demandées sont alignées sur les limites des VM.

Les capacités satisfaites correspondent au datastore provisionné, et la stratégie est associée à ce datastore.

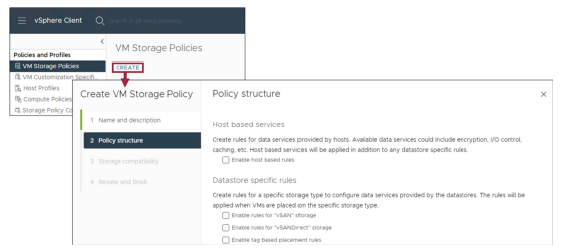

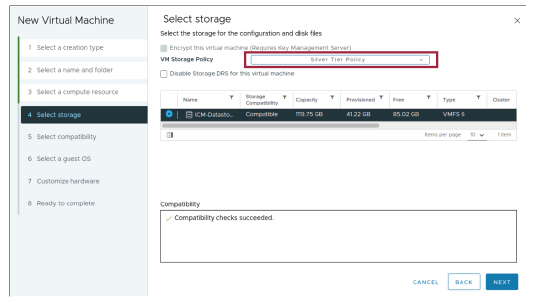

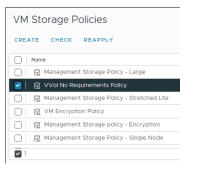

¶ À propos des stratégies de stockage des VM

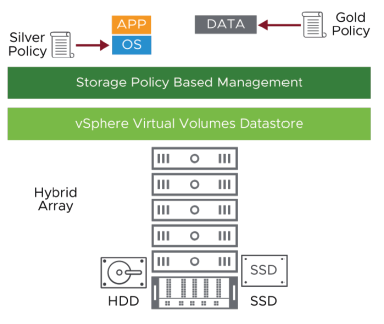

Une VM storage policy contrôle le type de stockage fourni à la machine virtuelle (VM) ainsi que la façon dont cette VM est placée dans le stockage.

Elle détermine également les services de données que la VM peut utiliser.

Les VM storage policies vous aident à atteindre les objectifs suivants :

- Catégoriser les datastores selon différents niveaux de service.

- Placer les disques de VM sur le stockage approprié.

Les VM storage policies capturent les caractéristiques de stockage dont les fichiers/objets principaux de la VM et les disques virtuels ont besoin pour exécuter les applications sur une VM.

Ces caractéristiques de stockage sont définies dans un ensemble de règles.

Les VM storage policies sont essentielles au provisionnement des VM.

Vous utilisez les VM storage policies lors du provisionnement d’une VM afin de garantir que les disques de la VM soient placés sur le stockage le mieux adapté à sa situation.

Par exemple, avec les VM storage policies, vous pouvez vous assurer qu’une VM exécutant une base de données critique et intensive en I/O soit placée dans le Gold tier.

Idéalement, vous cherchez à obtenir la meilleure correspondance possible entre les exigences de stockage prédéfinies pour la VM et les propriétés physiques du stockage disponible.

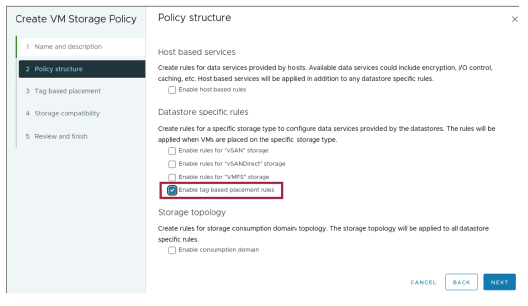

¶ À propos des règles de stratégie de stockage

Les règles sont les éléments de base d’une storage policy.

Chaque règle est une déclaration décrivant une exigence spécifique pour le stockage des VM et les services de données.

| Catégorie | Description | Exemples |

|---|---|---|

| Capability-based placement rules | Spécifient une exigence particulière de stockage pour la VM, ce qui guide la décision concernant le placement de la VM. | - Niveau RAID - Nombre de défaillances tolérées |

| Tag-based placement rules | Référencent les tags de datastore pour définir le placement de la VM. | - Gold Tier tag - Silver Tier tag - Bronze Tier tag |

| Data service rules | Activent des services de données spécifiques pour la VM, mais ne définissent pas le placement du stockage ni les exigences de stockage de la VM. | - Caching - Replication |

Les capability-based placement rules décrivent la manière dont les objets de stockage de VM sont alloués dans un datastore afin d’atteindre le niveau de service requis.

Par exemple, les règles peuvent lister les virtual volumes comme destination et définir l’objectif maximal de point de récupération (RPO) pour ces objets.

Le Storage Policy Based Management (SPBM) recherche les datastores de virtual volumes capables de correspondre à ces règles et de satisfaire les exigences de stockage de la VM.

Les tag-based placement rules utilisent les tags de datastore.

Vous pouvez employer ces règles basées sur les tags pour ajuster la demande de placement de votre VM.

Par exemple, vous pouvez exclure les datastores avec un tag spécifique, comme Palo Alto, de la liste de vos virtual volumes datastores.

Les data service rules activent des services de données spécifiques.

Les systèmes de stockage ou d’autres entités peuvent fournir ces services.

Ils peuvent également être installés sur vos hosts ESXi et votre vCenter.

Vous incluez les data service rules dans les composants de la storage policy.

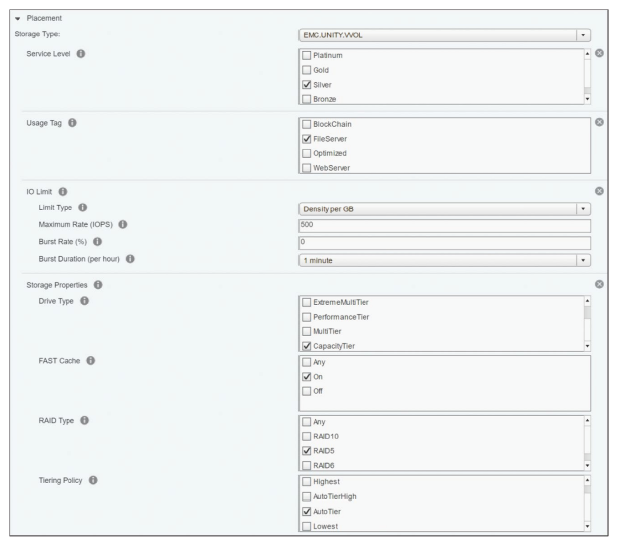

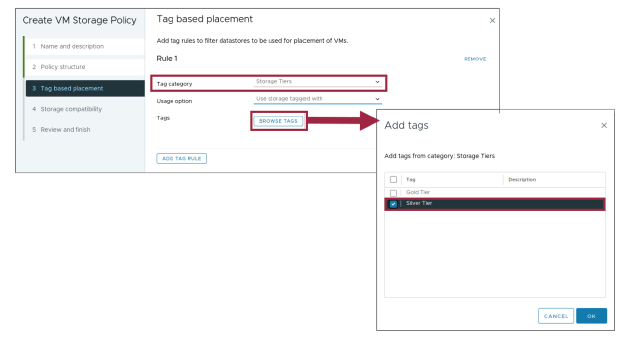

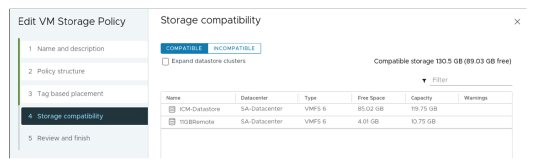

¶ Exemple de Storage Policy

Lorsque vous créez une storage policy, vous pouvez sélectionner une ou plusieurs règles qui représentent les niveaux de service exigés par les VMs.

Ces règles définissent les caractéristiques de stockage.

Chaque fournisseur de baies de stockage (array vendor) possède un namespace identifié.

Ce namespace contient les identifiants des conteneurs de stockage ainsi que leurs capacités attribuées.

Les capabilities apparaissent ensuite comme options dans l’interface client.

Les VM storage policies permettent de vérifier que les VMs s’exécutent sur un stockage correspondant aux caractéristiques de performance et de disponibilité requises.

Pour vSAN et les virtual volumes, les VM storage policies garantissent que les VMs sont placées sur le stockage approprié.

Par exemple, pour placer les disques d’un serveur de base de données sur le bon type de stockage :

- Attribuez la Silver policy au disque du système d’exploitation :

la Silver policy est configurée pour n’utiliser que des HDDs. - Attribuez la Gold policy au disque de données :

la Gold policy utilise uniquement des SSDs.

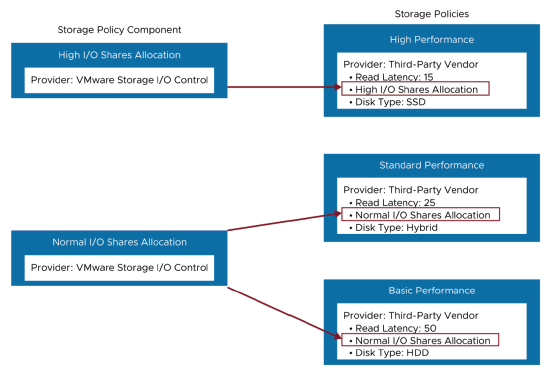

¶ À propos des composants de Storage Policy

Une VM storage policy peut inclure un ou plusieurs blocs de construction réutilisables et interchangeables, appelés composants de Storage Policy, en utilisant les services de stockage basés sur VAIO.

Chaque composant décrit un type de service fourni par un fournisseur de stockage.

Les services varient selon le fournisseur de stockage utilisé, mais ils appartiennent généralement à l’une des catégories suivantes :

- Réplication

- Chiffrement

- Mise en cache (Caching)

- Contrôle des entrées/sorties de stockage (Storage I/O Control)

Le fournisseur de services peut être un système de stockage, un filtre d’E/S (I/O filter) ou une autre entité.

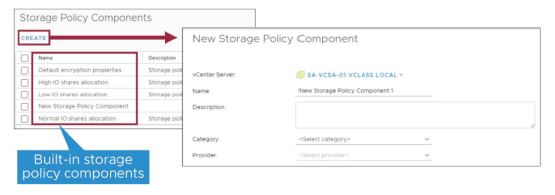

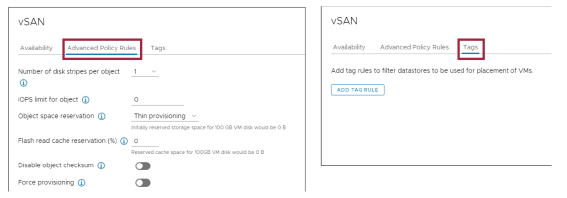

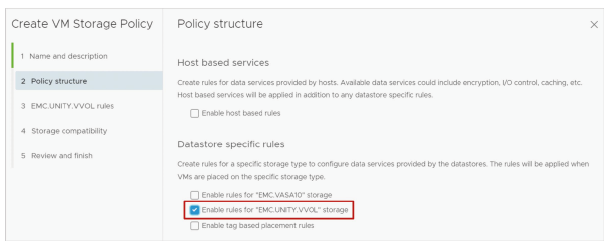

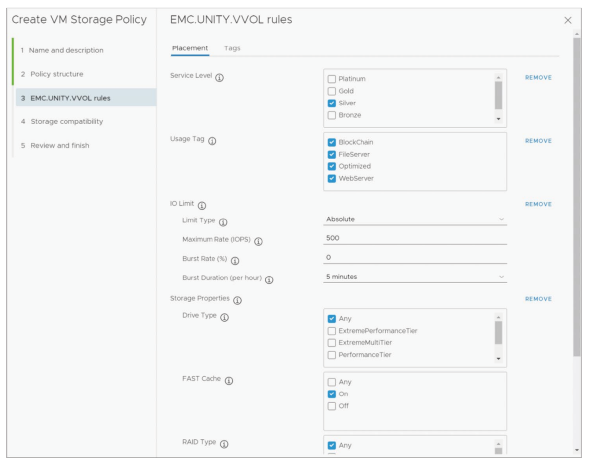

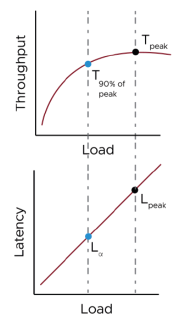

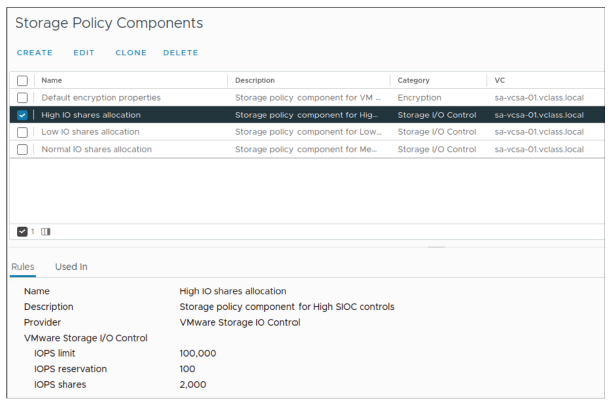

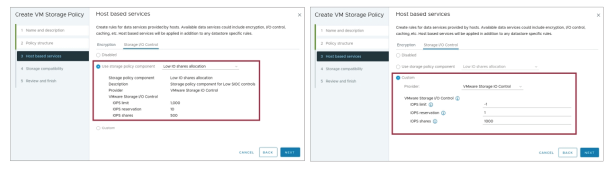

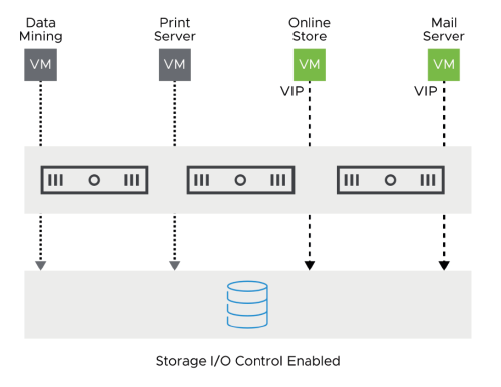

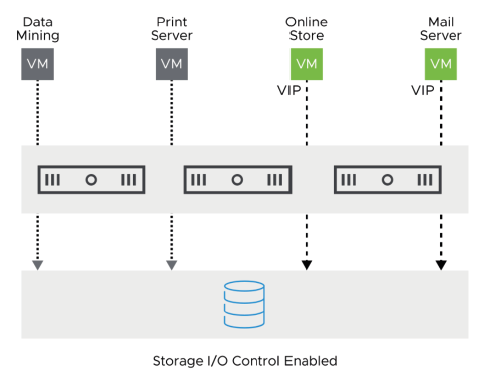

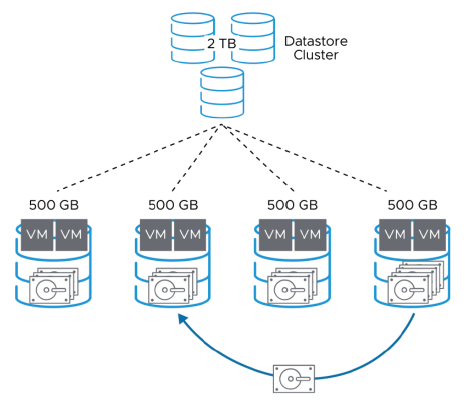

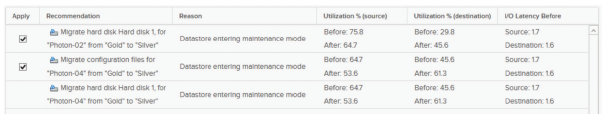

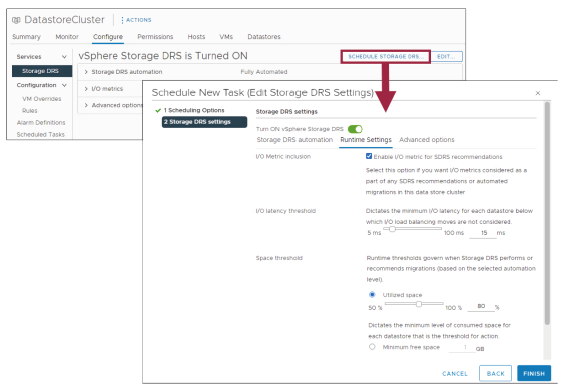

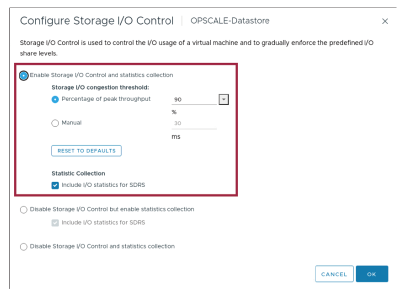

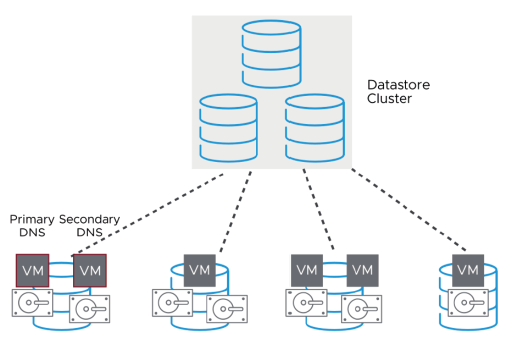

¶ Exemple de composant de Storage Policy