¶ VMware vSphere : Install, Configure, Manage

Lab 23 : Contrôle des ressources des VMs

¶ Introduction

Ce Lab a pour objectif d'illustrer la documentation permettant de se préparer au passage de la certification VMWare Certified Professional - Data Center Virtualization v8 (2V0-21.23).

Plus précisément le chapitre 8 - Gestion des machines virtuelles (VMs).

Cours Traité : Leçon 7 : Contrôles des ressources

Avant de commencer, je tiens à préciser qu'il est préférable d'avoir lu la documentation.

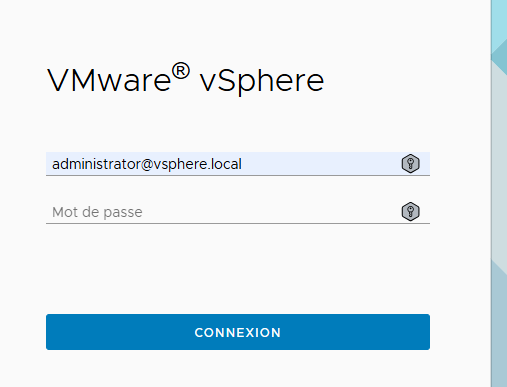

Pour réaliser l'ensemble des différents Labs j'ai dans un premier temps créé un environnement virtuel comprenant les éléments suivants :

- 1 vCenter : LAB-VCENTER-01.LAB.LOCAL

- 3 ESXi Nested : LAB-ESXI-01.LAB.LOCAL, LAB-ESXI-02.LAB.LOCAL et LAB-ESXI-03.LAB.LOCAL

- 1 Windows Server 2025 (eval) : LAB-AD-01 pour l'Active Directory

Selon le lab, tous ces éléments ne sont pas forcément utilisés cependant ils le seront au fur et à mesure des différents labs.

De ce fait, pour reproduire les Lab , il est conseillé d'avoir à disposition un environnement équivalant.

Je vais partir du principe que vous possédez un Lab à disposition.

¶ Objectif et tâches

Observer le comportement des machines virtuelles (VMs) avec différentes valeurs de CPU shares :

- Créer une contention CPU

- Vérifier la fonctionnalité des CPU shares

¶ Tâche 1 : Créer une contention CPU

Vous créez une contention CPU entre les machines virtuelles VM-LAB-2 et VM-LAB-5 afin de tester votre environnement de Lab.

Vous utilisez la fonctionnalité CPU scheduling affinity pour forcer les deux VMs à être planifiées sur le même processeur logique (logical CPU) et exécutez le script cpubusy.sh sur les deux VMs afin de générer de l’activité CPU.

En créant cette contention, vous forcez les VMs à se partager les ressources CPU logiques limitées de l’hôte ESXi.

Cette approche peut entraîner une dégradation des performances.

- Connectez vous à vCenter en utilisant le compte Administrator@vsphere.local.

Le compte Administrator@vsphere.local est le compte utilisateur par défaut que l'on trouve sur vCenter après son installation.

Pour se connecter il faudra utiliser cette URL : https://<vCenter_FQDN_or_IP_Address>/ui.

Dans le cas de mon Lab ça sera donc soit "lab-vcenter-01.lab.local/ui" soit l'adresse IP de vCenter.

- Ouvrir un navigateur Web et se connecter à l'URL de vCenter

- Se connecter avec l'utilisateur Administrator@vsphere.local

- Dans le menu principal, sélectionnez Inventory, puis cliquez sur l’icône Hosts and Clusters.

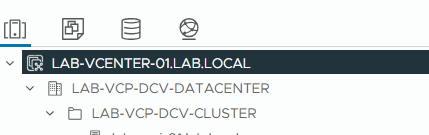

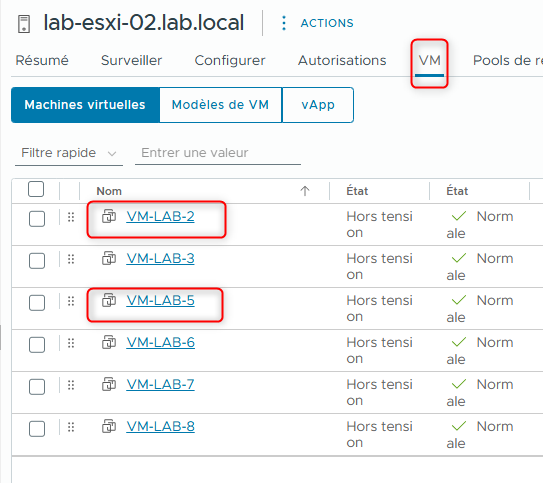

- Vérifiez que les VMs VM-LAB-2 et VM-LAB-5 sont éteintes.

- Vérifiez que VM-LAB-2 et VM-LAB-5 se trouvent sur l’hôte lab-esxi-02.lab.local.

-

Dans le volet de navigation, sélectionnez lab-esxi-02.lab.local.

-

Dans le volet de droite, cliquez sur l’onglet VMs.

-

Vérifiez que VM-LAB-2 et VM-LAB-5 apparaissent dans la liste.

- Si VM-LAB-2 ou VM-LAB-5 ne se trouve pas sur lab-esxi-02.lab.local, migrez la VM vers cet hôte.

- Dans le volet de navigation, faites un clic droit sur la VM et sélectionnez Migrate.

- Sur la page Select a migration type, cliquez sur Change compute resource only, puis cliquez sur NEXT.

- Sur la page Select a compute resource, sélectionnez lab-esxi-02.lab.local, puis cliquez sur NEXT.

- Sur la page Select networks, conservez les valeurs par défaut, puis cliquez sur NEXT.

- Sur la page Ready to complete, cliquez sur FINISH.

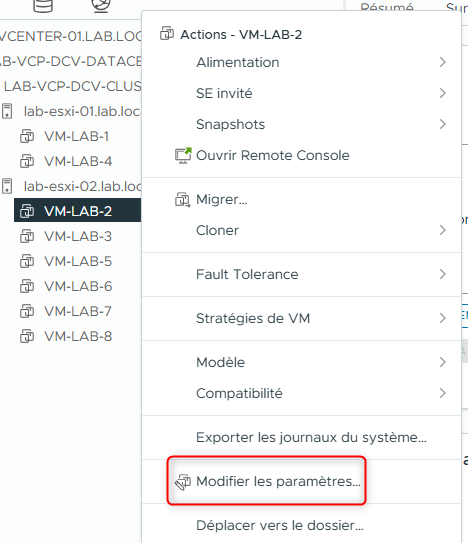

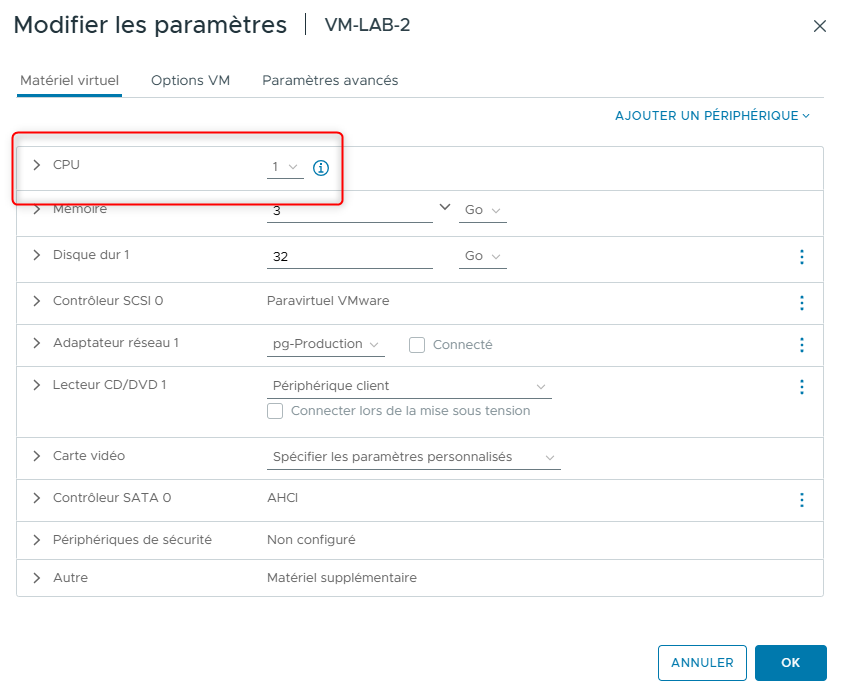

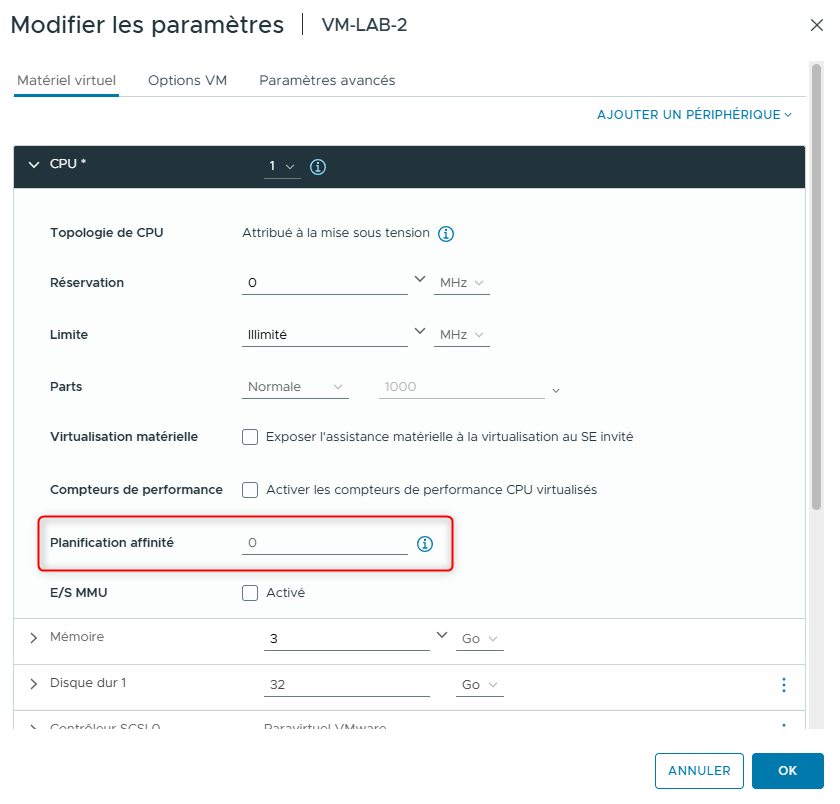

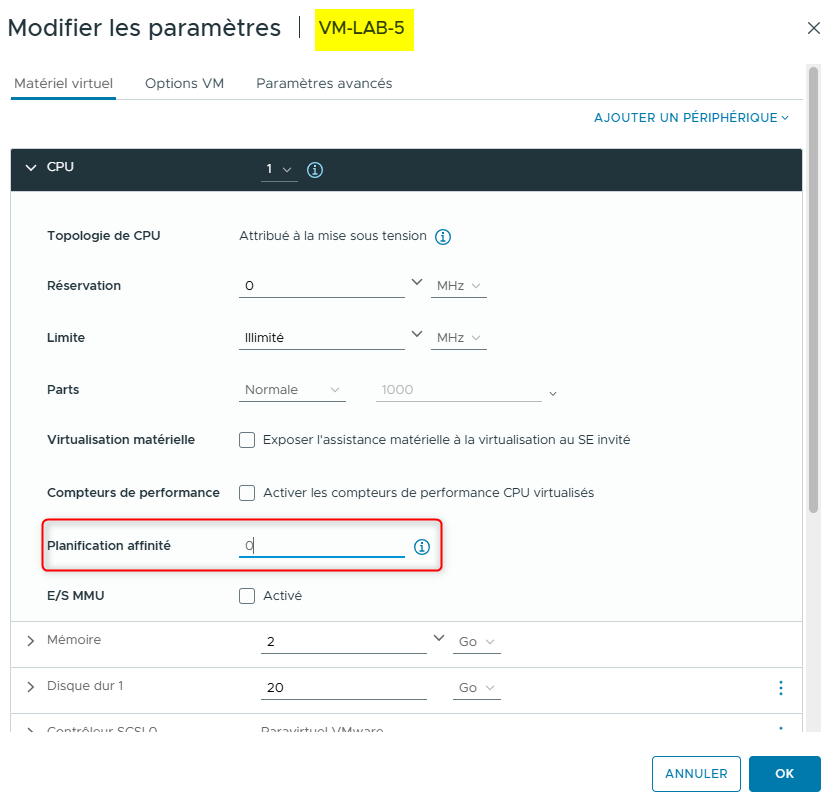

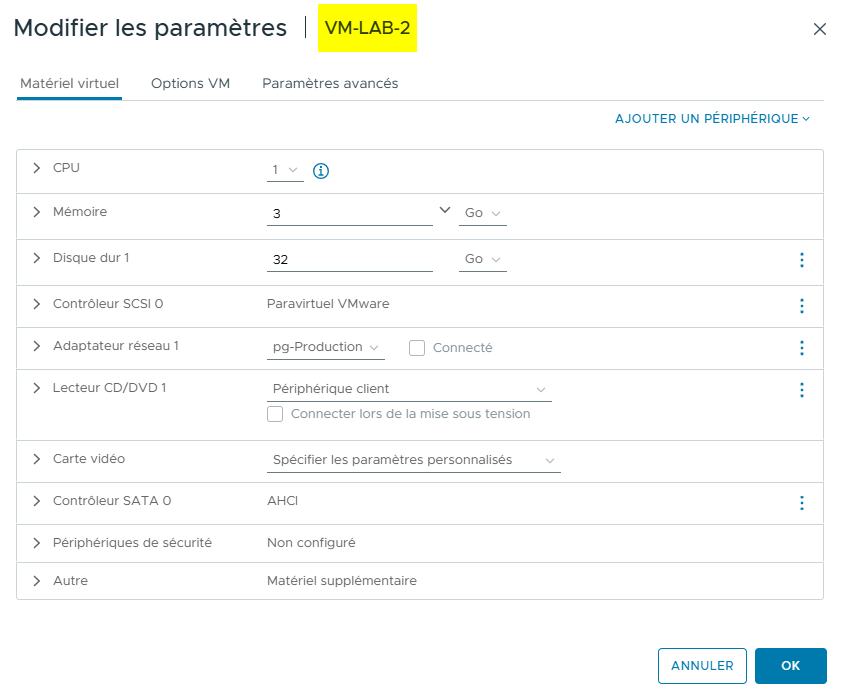

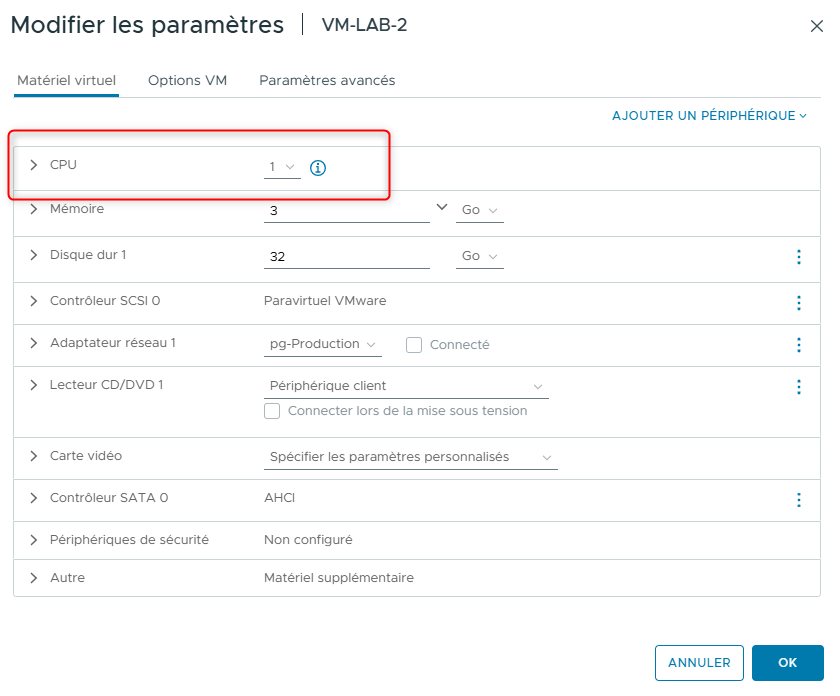

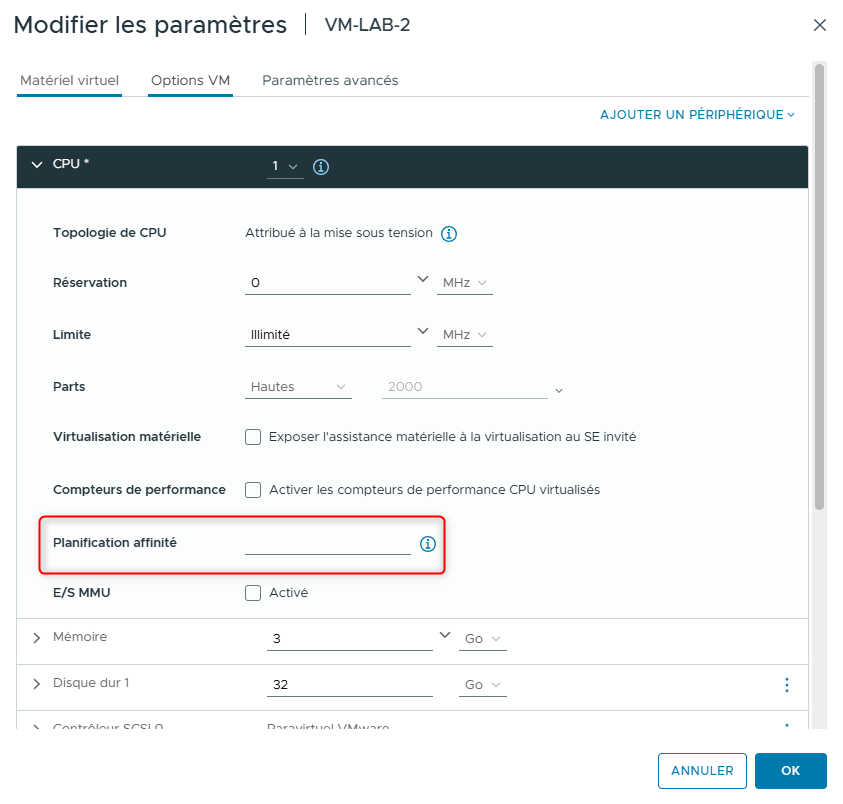

- Configurez VM-LAB-2 et VM-LAB-5 pour qu’elles s’exécutent uniquement sur le CPU logique 0.

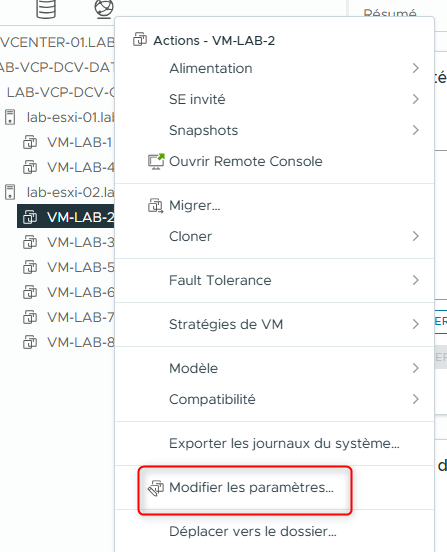

- Dans le volet de navigation, faites un clic droit sur VM-LAB-2 et sélectionnez Edit Settings.

- Dans l’onglet Virtual Hardware, développez le volet CPU.

- Dans la zone de texte Scheduling Affinity, entrez 0.

Ce paramètre force VM-LAB-2 à s’exécuter uniquement sur le CPU logique 0.

- Cliquez sur OK.

IMPORTANT : L’affinité de planification CPU (CPU scheduling affinity) est utilisée dans ce Lab uniquement à des fins de formation pour créer une contention CPU. VMware déconseille fortement l’utilisation de cette fonctionnalité dans un environnement de production.

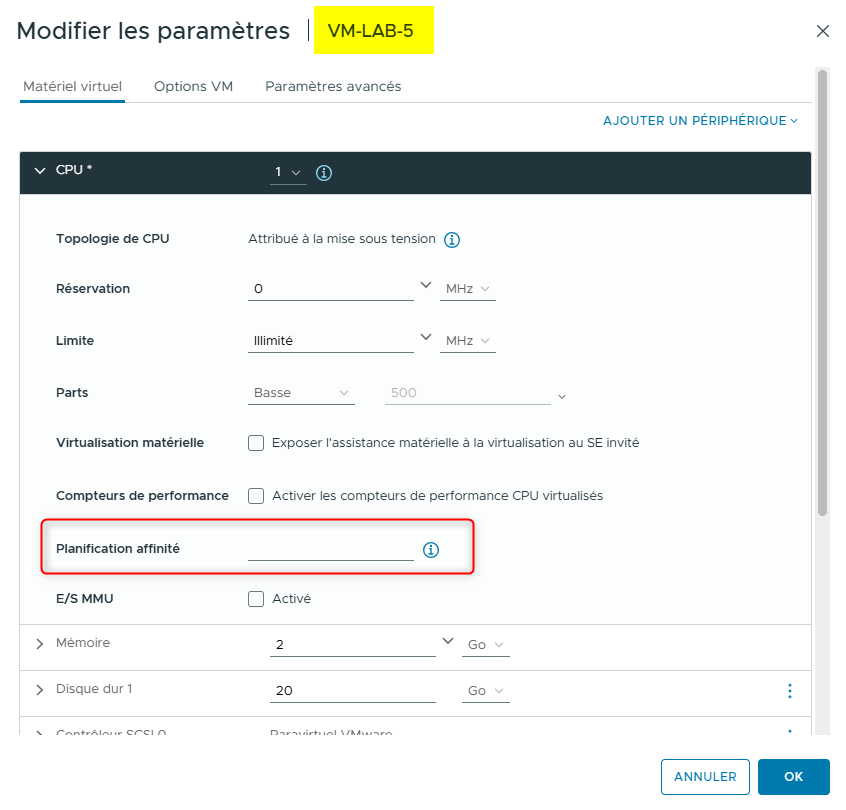

- Répétez ces étapes pour la VM VM-LAB-5.

-

Mettez sous tension VM-LAB-2 et VM-LAB-5.

-

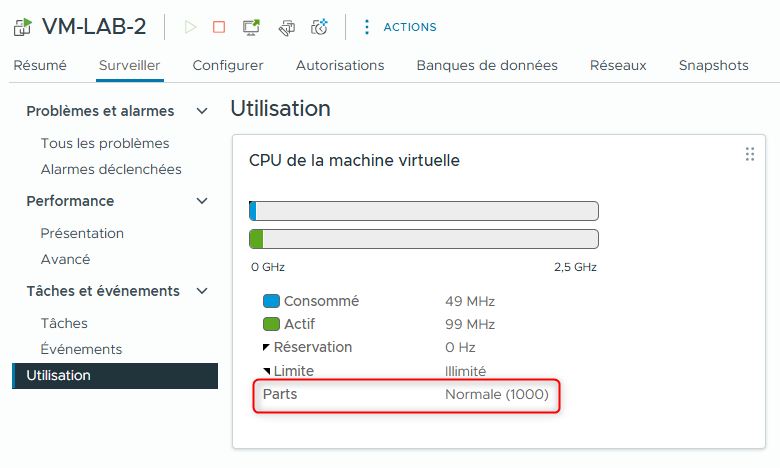

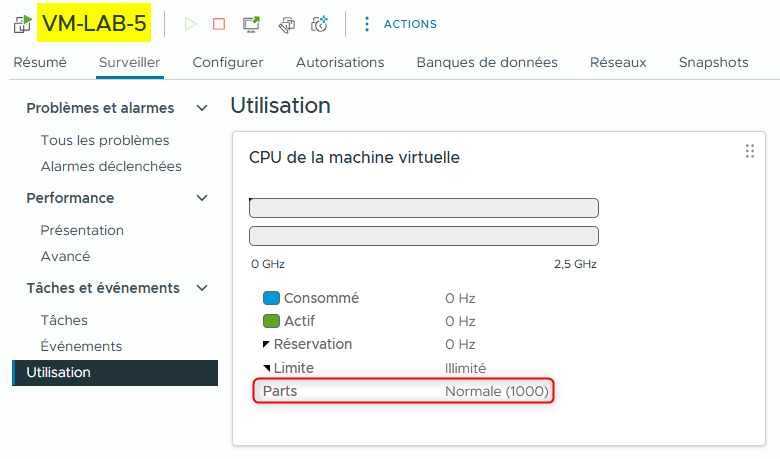

Vérifiez que VM-LAB-2 et VM-LAB-5 ont chacune une valeur de CPU shares égale à Normal.

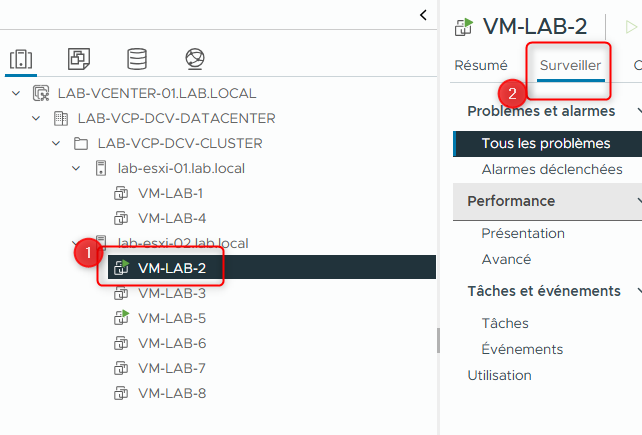

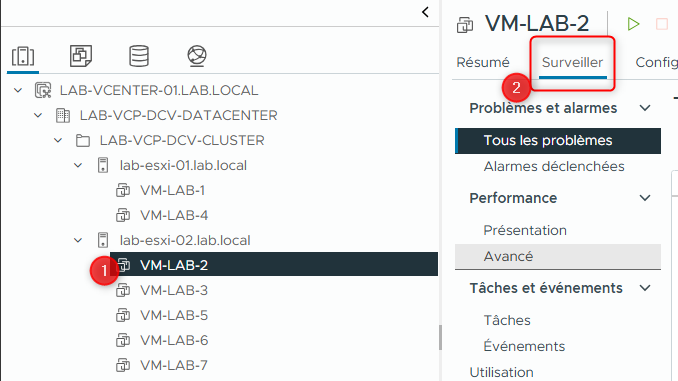

- Dans le volet de navigation, sélectionnez VM-LAB-2, puis cliquez sur l’onglet Monitor dans le volet de droite.

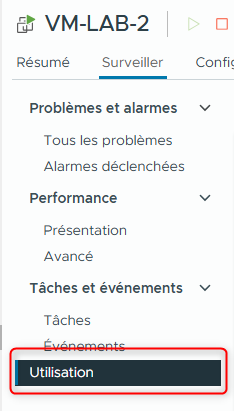

- Sélectionnez Utilization dans le volet de droite.

- Dans le volet Virtual Machine CPU, vérifiez que la valeur Shares est Normal (1000).

- Répétez ces étapes pour VM-LAB-5.

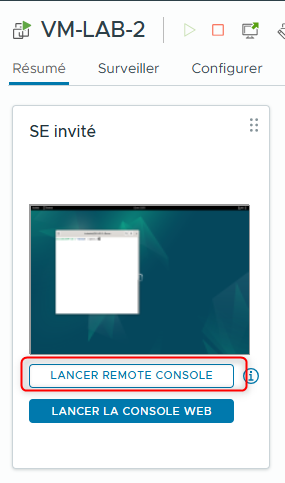

- Ouvrez les consoles distantes (remote consoles) de VM-LAB-2 et VM-LAB-5, puis attendez que les VMs aient complètement démarré.

- Dans l’onglet Summary de la machine virtuelle, cliquez sur LAUNCH REMOTE CONSOLE.

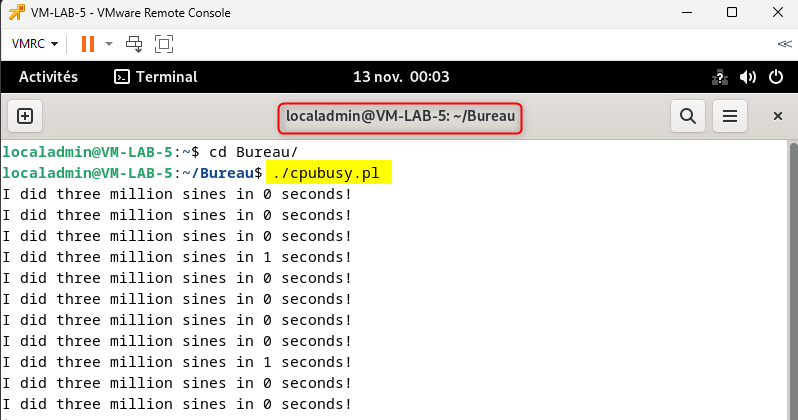

- Démarrez le script

cpubusy.pl(disponible ici : cpubusy.pl) depuis la ligne de commande sur VM-LAB-2 et VM-LAB-5.

-

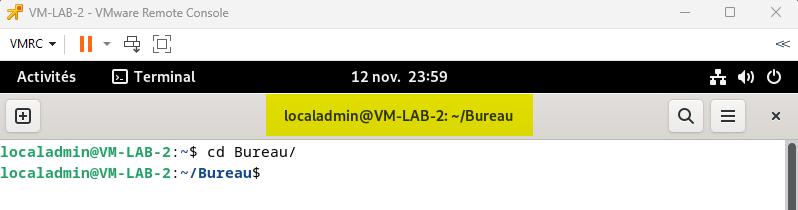

Ouvrez un Terminal Linux sur VM-LAB-2.

-

Saisissez

cd Desktoppour accéder au dossier Desktop.

- Saisissez

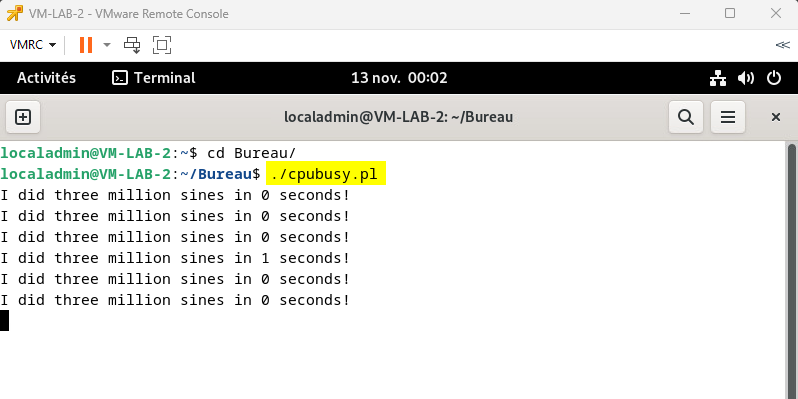

./cpubusy.plpour lancer le script cpubusy.

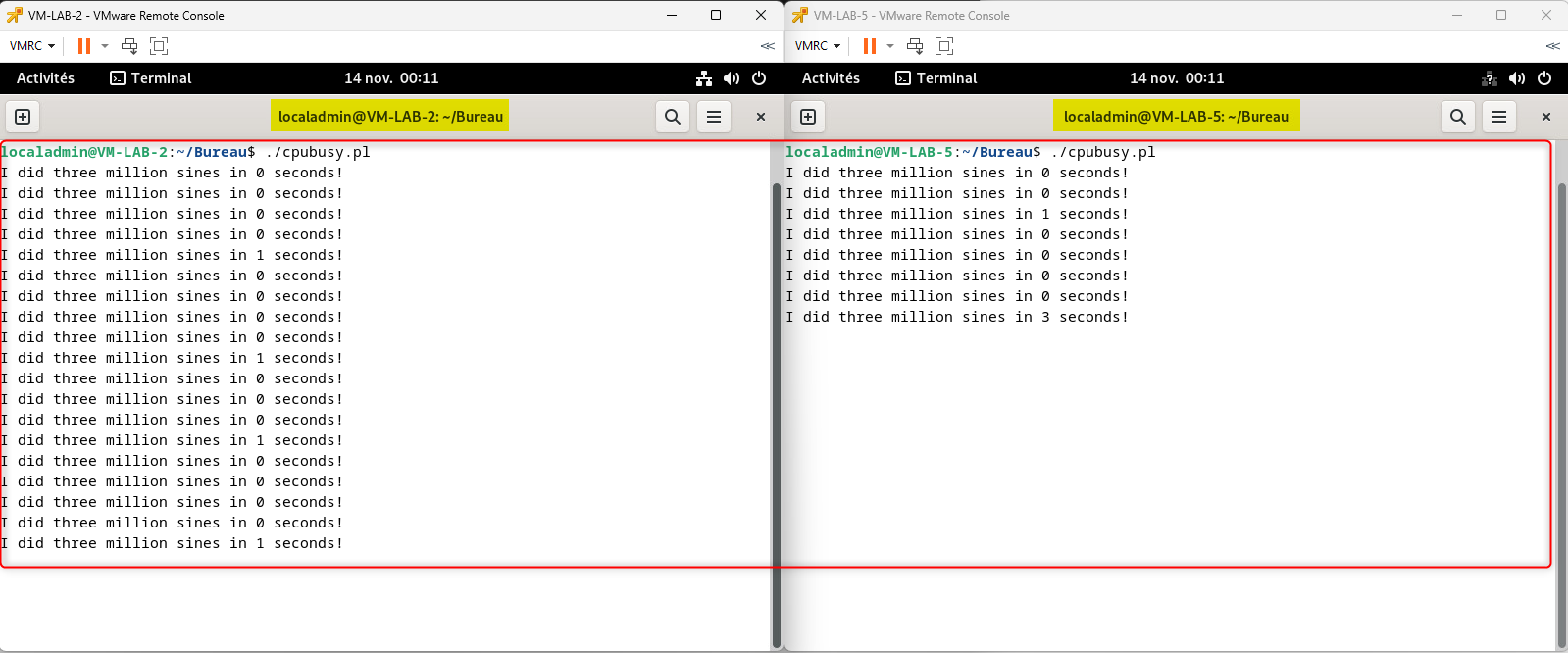

Ce script s’exécute en continu et se stabilise en 1 à 2 minutes. Il effectue des calculs en virgule flottante de manière répétée et affiche la durée d’un calcul (wall-clock time),

par exemple : I did three million sines in 1 seconds!

- Répétez les étapes a à c pour VM-LAB-5.

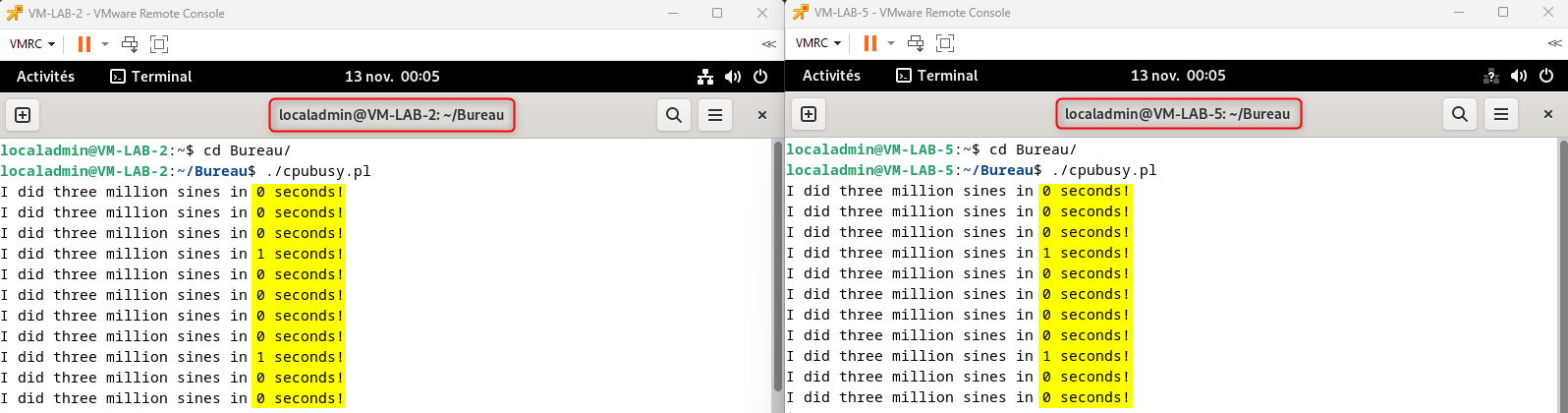

Vous pouvez utiliser le nombre de secondes affiché comme estimation de performance.

Le programme doit s’exécuter à une vitesse similaire sur chaque machine virtuelle.

- Après 1 à 2 minutes, vérifiez que la valeur de durée de calcul (en secondes) est similaire entre VM-LAB-2 et VM-LAB-5.

¶ Question :

- Q1. Pourquoi les valeurs sont-elles similaires ?

¶ Réponse :

- R1. Les valeurs sont similaires car les deux machines virtuelles possèdent le même niveau de CPU shares (Normal) et sont assignées au même processeur logique.

Elles se partagent donc équitablement les ressources CPU disponibles, entraînant des performances comparables.

¶ Tâche 2 : Vérifier la fonctionnalité des partages CPU

Vous allez vérifier que les machines virtuelles (VMs) reçoivent la bonne allocation CPU en situation de contention.

L’allocation CPU est déterminée en fonction du nombre de parts (shares) attribué à chaque VM.

-

Revenez dans le vSphere Client.

-

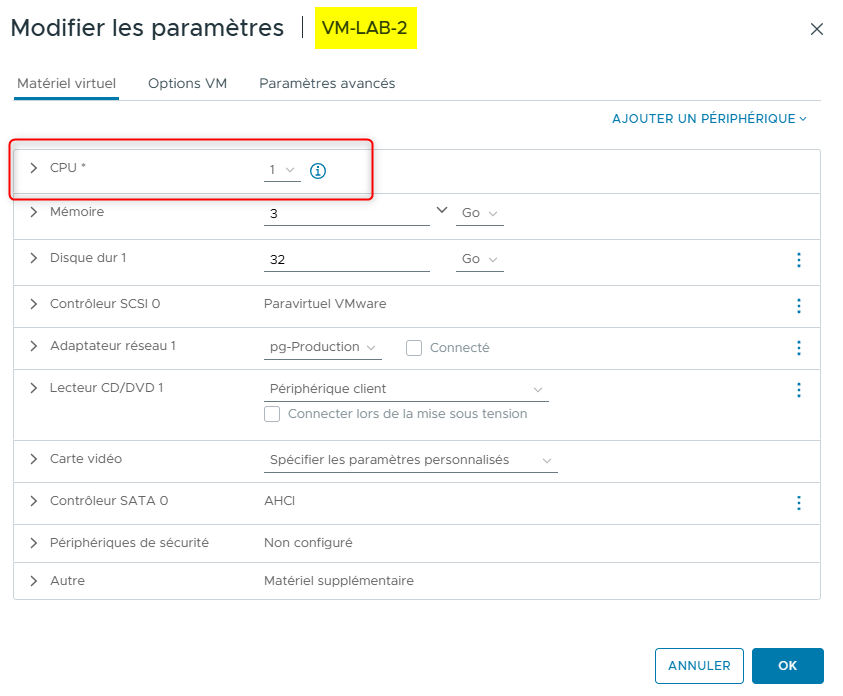

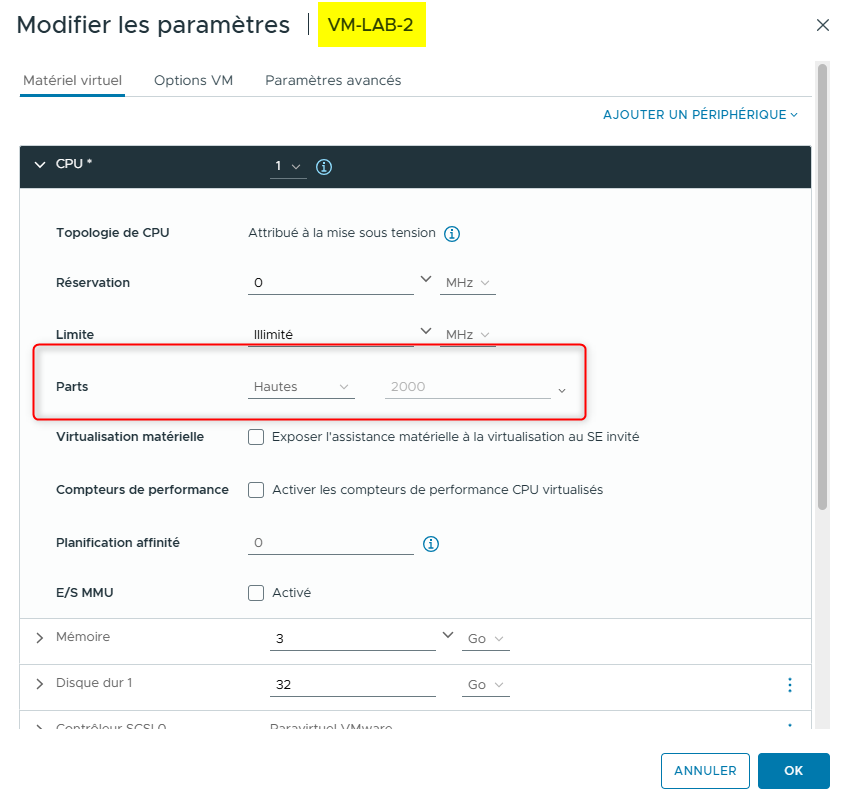

Modifiez le nombre de parts CPU de VM-LAB-2 pour le définir sur High (élevé).

- Dans le volet de navigation, faites un clic droit sur VM-LAB-2 et sélectionnez Edit Settings.

- Dans l’onglet Virtual Hardware, développez le volet CPU.

- Dans le menu déroulant Shares, sélectionnez High.

Lorsque le paramètre est défini sur High, la VM se voit attribuer 2000 shares.

- Cliquez sur OK.

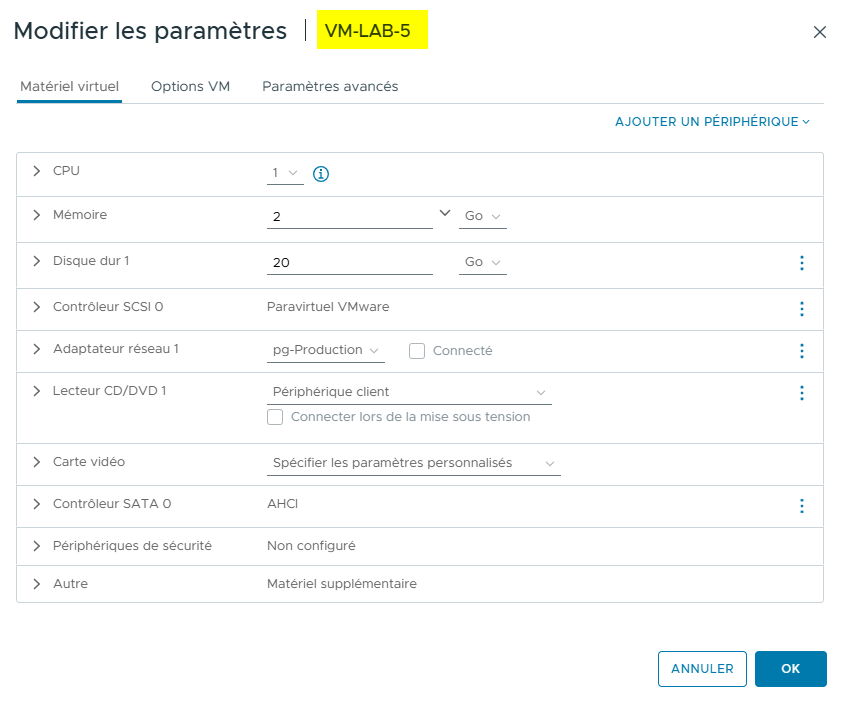

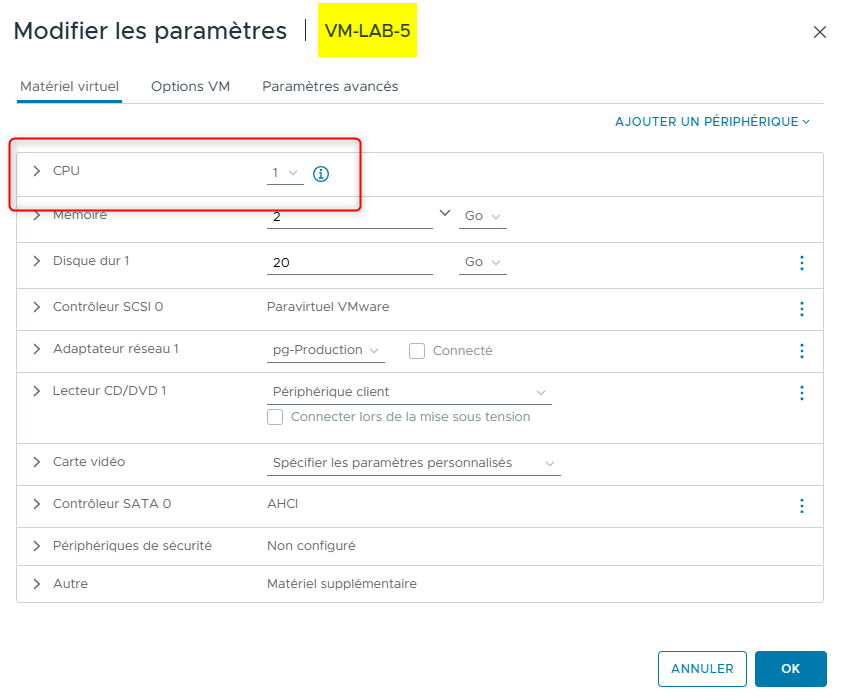

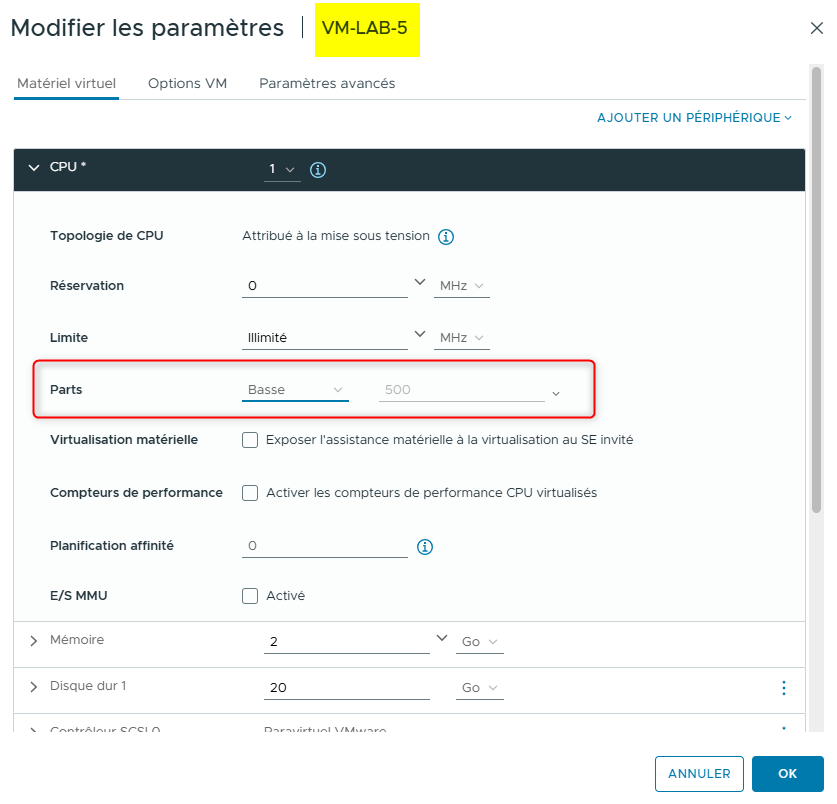

- Modifiez le nombre de parts CPU de VM-LAB-5 pour le définir sur Low (faible).

- Dans le volet de navigation, faites un clic droit sur VM-LAB-5 et sélectionnez Edit Settings.

- Dans l’onglet Virtual Hardware, développez le volet CPU.

- Dans le menu déroulant Shares, sélectionnez Low.

Lorsque le paramètre est défini sur Low, la VM se voit attribuer 500 shares.

- Cliquez sur OK.

- Vérifiez que les partages CPU sont correctement configurés :

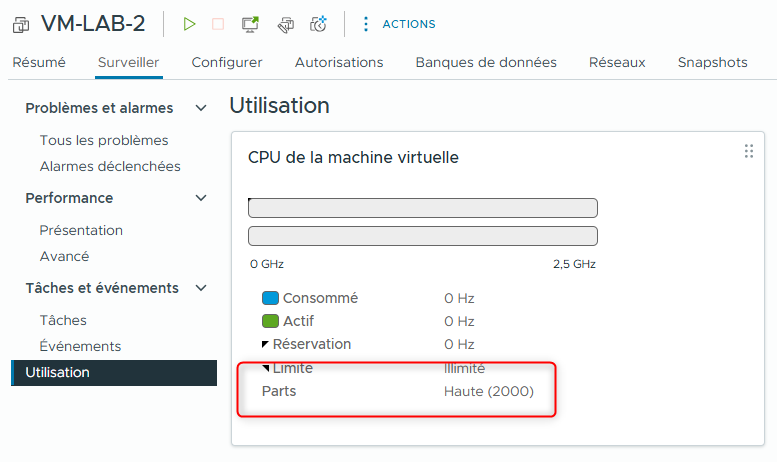

- Sélectionnez VM-LAB-2 et cliquez sur l’onglet Monitor.

- Sélectionnez Utilization et vérifiez que la valeur Shares est High (2000).

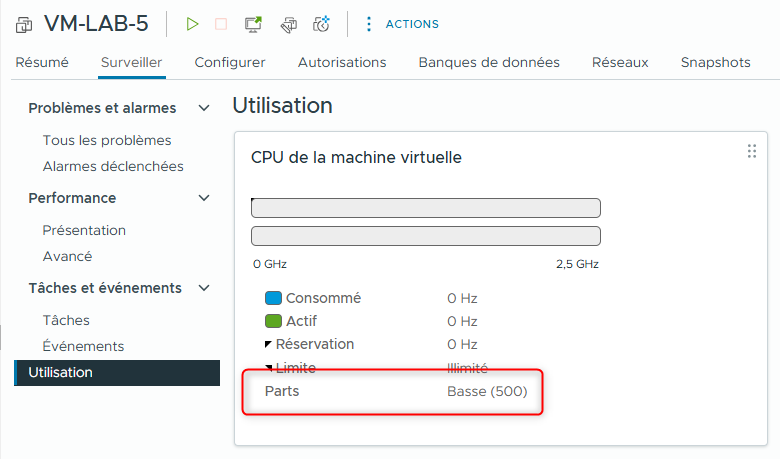

- Répétez ces étapes pour VM-LAB-5 et vérifiez que la valeur Shares est Low (500).

- Revenez dans la console de chaque VM et observez les résultats du script cpubusy.sh.

¶ Question :

- Q1. Quelle est la différence de performance entre VM-LAB-2 et VM-LAB-5 ?

¶ Réponse :

- R1. VM-LAB-5 dispose de seulement un quart des parts CPU attribuées à VM-LAB-2.

Par conséquent, VM-LAB-5 reçoit environ un quart des cycles CPU du processeur logique auquel les VMs sont liées (affinité CPU).

- Fermez la fenêtre du terminal dans chaque console VM pour arrêter le script cpubusy.sh.

ATTENTION Le script doit être arrêté sur chaque machine virtuelle, sinon il risque d’affecter les performances des labs suivants.

-

Fermez les fenêtres de console de VM-LAB-2 et VM-LAB-5.

-

Arrêtez (shut down) les VMs VM-LAB-2 et VM-LAB-5.

-

Supprimez l’affinité CPU (CPU Scheduling Affinity) de VM-LAB-2 et VM-LAB-5.

Vous ne pouvez pas modifier l’affinité CPU tant que les VMs sont sous tension.

Assurez-vous que les VMs sont éteintes avant de continuer.

- Dans le volet de navigation, faites un clic droit sur VM-LAB-2 et sélectionnez Edit Settings.

- Dans l’onglet Virtual Hardware, développez le volet CPU.

- Supprimez le “0” de la zone de texte Scheduling Affinity.

Cette zone doit être vide.

-

Cliquez sur OK.

-

Répétez ces étapes pour la VM VM-LAB-5.

Lab précédent : Lab 22 : Travailler avec les Snapshots

Lab suivant : Lab 24 : Mise en œuvre des clusters vSphere DRS